Gouvernance

Dans l’ombre d’Alan Turing, 29 signataires* scellent un (étonnant) pacte d’avenir pour l’IA

Par Thierry Derouet, publié le 03 novembre 2023

Après le Biden Act, la « déclaration de Bletchley Park » a vu la Chine, les États-Unis, l’Union européenne et une vingtaine de pays signer une déclaration pour un développement « sûr » de l’IA.

Bletchley Park, manoir autrefois au centre des prouesses de décryptage d’Alan Turing et de son équipe durant la Seconde Guerre mondiale, a reçu pendant deux jours, dirigeants politiques, experts de l’IA et géants de la Tech. À Bletchley Park, c’est à « huis clos », que des figures telles que le Premier ministre Rishi Sunak, Kamala Harris, Ursula von der Leyen, Elon Musk et les experts en IA Geoffrey Hinton et Yoshua Bengio ont débattu des risques de l’IA et de la nécessité de la réguler. Même le roi Charles III a — à distance — apporté sa contribution lors du discours d’ouverture.

Les intervenants y ont exploré les perspectives, les enjeux et l’éthique de cette technologie en évolution rapide. Au terme de ces discussions, la « déclaration de Bletchley » a été adoptée, marquant une résolution partagée en faveur d’une IA responsable, sécurisée et au service de tous.

Bletchley Park, une réunion pour cadrer, pas pour encadrer

Mais ne nous méprenons pas. Car comme la ministre britannique de la Technologie Michelle Donelan a tenu à le souligner, « Cette réunion n’a pas pour objectif de poser les bases d’une législation mondiale, elle doit servir à tracer une voie à suivre. »

Ainsi, la déclaration reconnaît les avantages potentiels de l’IA pour l’humanité, tout en mettant en évidence les risques qu’elle pourrait représenter dans des domaines aussi variés que la sécurité, les droits de l’homme ou l’économie. Elle établit des engagements dans quatre domaines principaux : la gouvernance, la sécurité, l’éthique et les bénéfices de l’IA.

Les signataires s’engagent toutefois à mettre en place des cadres juridiques et réglementaires pour garantir que l’IA soit sur certains points transparente et responsable. Ils se consacrent également à renforcer la sécurité de l’IA, à respecter les principes éthiques fondamentaux et à promouvoir une IA qui bénéficie à tous, en ligne avec les objectifs de développement durable des Nations unies.

Des divergences pourtant profondes entre États

Toutefois, comment définir des garde-fous sans entraver l’innovation pour les laboratoires d’IA et géants de la Tech ? Car cette déclaration de Bletchley masque des divergences profondes entre l’UE et les États-Unis – qui contrairement au Royaume-Uni – ont choisi la voie de la réglementation.

Certains participants, tels qu’Elon Musk, ont exprimé leur scepticisme quant à la capacité des dirigeants politiques à vraiment comprendre l’IA, déclarant : « Avant de réguler, il faut d’abord comprendre ».

Autre voix à s’exprimer, Stéphane Roder, PDG d’AI Builders voit la conférence de Bletchley comme une étape positive, la comparant à des institutions comme l’AIEA pour le nucléaire. Il suggère que c’est un moyen d’harmoniser les grandes puissances sur une compréhension commune de l’IA et de restaurer la confiance du public. Cependant, il rappelle aussi qu’il ne faut pas oublier les utilisations controversées de l’IA, comme la notation sociale en Chine ou son intégration dans les armements mondiaux.

À qui profite l’IA ?

Cette quête de confiance ne masque-t-elle pas en réalité une imminente guerre économique autour de l’IA ? Même si Emmanuel Macron n’était pas présent pour des raisons d’agenda, la France – qui a annoncé accueillir le prochain sommet en 2025 (bien que la date reste à déterminer) – ne se doit-elle pas, en Européens, d’aborder frontalement cette question ? Car qui détient aujourd’hui les serveurs, les microprocesseurs, les modèles linguistiques ? Au service de qui œuvrent ces esprits brillants qui vectorisent les connaissances mondiales ? Et qui tire réellement profit de l’IA ? Est-ce vraiment pour le seul bénéfice de l’humanité ?

À LIRE AUSSI :

Déclaration de Bletchley Park, les 12 points clés de l’accord

La « déclaration de Bletchley » établit un plan d’action pour une collaboration globale, s’assurant que l’IA soit conçue et mise en œuvre de façon éthique et sûre.

1. Gouvernance de l’IA

Cadres juridiques et réglementaires :

Les pays signataires reconnaissent la nécessité d’avoir des mécanismes clairs pour assurer que l’IA soit développée et utilisée de manière responsable. Cela comprend des directives sur la responsabilité en cas de défaillance ou d’utilisation abusive de l’IA.

Coopération internationale :

Étant donné que l’IA est une technologie sans frontières, une coopération internationale est essentielle pour partager les meilleures pratiques et éviter les doubles emplois.

Normes existantes :

Les pays sont encouragés à se conformer aux normes éthiques déjà établies, évitant ainsi la fragmentation des réglementations.

2. Sécurité de l’IA

Recherche sur la sécurité :

Renforcer la recherche pour garantir que l’IA fonctionne comme prévu, même dans des conditions non idéales ou face à des interventions malveillantes.

Culture de sécurité :

Il ne s’agit pas seulement de créer des systèmes sécurisés, mais aussi de s’assurer que ceux qui développent et utilisent l’IA sont bien informés des enjeux de sécurité.

Lutte contre l’utilisation abusive :

Reconnaître les organisations qui peuvent aider à prévenir des scénarios comme le blanchiment d’argent ou le financement du terrorisme via des systèmes basés sur l’IA.

3. Éthique de l’IA

Principes éthiques :

Au-delà de la simple sécurité, l’IA doit respecter la dignité humaine, éviter la discrimination et œuvrer pour le bien-être de tous.

Diversité et pluralisme :

L’IA doit être conçue et utilisée en respectant la diversité culturelle et sociale, garantissant qu’elle ne favorise pas involontairement certains groupes au détriment d’autres.

Dialogue interdisciplinaire :

Encourager la collaboration entre différentes disciplines pour assurer une réflexion éthique complète sur l’IA.

4. Bénéfices de l’IA

IA inclusive :

Veiller à ce que l’IA soit utilisée pour réduire les inégalités et non pour les accentuer.

Innovation et compétitivité :

Favoriser un environnement où les entreprises peuvent innover tout en garantissant que l’IA est utilisée de manière éthique.

Éducation :

Reconnaître que le monde change avec l’IA, et que l’éducation continue est essentielle pour aider les individus à s’adapter à ce nouvel environnement.

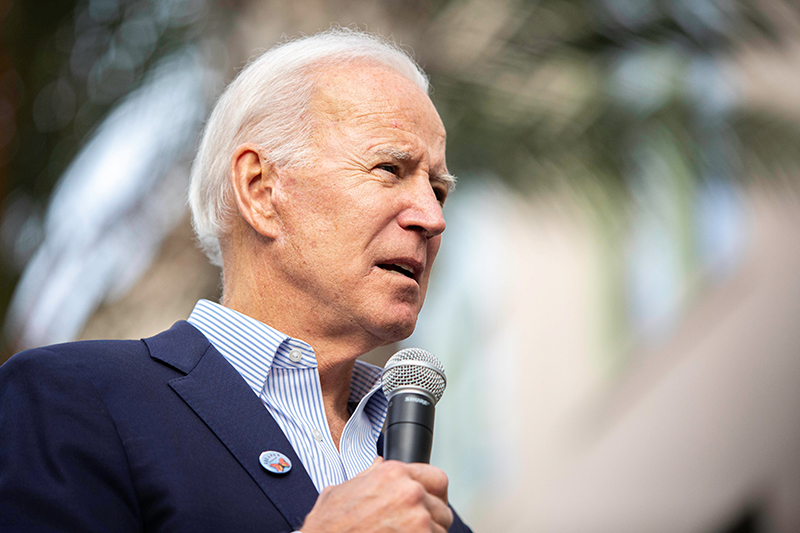

Aux USA, Joe Biden signe un décret pour encadrer l’IA

Le 29 octobre 2023, le président des États-Unis Joe Biden a prononcé un discours à la nation sur l’intelligence artificielle (IA), dans lequel il a annoncé la signature d’un décret présidentiel visant à encadrer le développement et l’utilisation de l’IA aux États-Unis.

Le décret impose des règles aux entreprises qui développent des modèles d’IA puissants, notamment l’obligation de partager leurs données et leurs résultats de tests avec le gouvernement, lorsque ces modèles présentent un risque pour la sécurité nationale, la santé publique ou la sécurité économique. Le décret vise également à anticiper et à gérer les risques liés à l’IA, tels que les contenus frauduleux générés par l’IA, les biais et les discriminations algorithmiques, l’impact sur le marché du travail ou la menace pour la vie privée.

Par ailleurs, le décret prévoit des mesures pour soutenir l’innovation et la compétitivité dans le domaine de l’IA, en facilitant l’accès aux financements fédéraux, aux visas et à la formation pour les acteurs du secteur. Joe Biden a affirmé que les États-Unis devaient être les leaders mondiaux dans le domaine de l’IA, tout en respectant les valeurs démocratiques et les droits de l’homme. Il a également appelé à une coopération internationale pour promouvoir une IA sûre, éthique et bénéfique pour tous.

* Australie, Brésil, Canada, Chili, Chine, Union européenne, France, Allemagne, Inde, Indonésie, Irlande, Israël, Italie, Japon, Kenya, Royaume d’Arabie Saoudite, Pays-Bas, Nigéria, Les Philippines, République de Corée, Rwanda, Singapour, Espagne, Suisse, Turquie, Ukraine, Émirats arabes unis, Royaume-Uni de Grande-Bretagne et d’Irlande du Nord, États-Unis d’Amérique

À LIRE AUSSI :