@Work

Ce que les nouvelles consoles PS5 et XBox Series X peuvent apprendre aux DSI…

Par Laurent Delattre, publié le 24 décembre 2020

Microsoft et Sony ont lancé pour les fêtes de fin d’année leur nouvelle génération de consoles de jeux. Leurs spécifications techniques en disent long sur l’avenir de nos PC et stations de travail. Voici ce que les DSI doivent en retenir… Histoire de se changer les idées avec un thème à la fois ludique et instructif…

« Le jeu vidéo et le porno sont les deux principaux moteurs de l’innovation de l’informatique ». Ce vieil adage se retrouve une nouvelle fois vérifié avec l’arrivée de la « Xbox Series X » de Microsoft et de la « PS5 » de Sony.

Les deux consoles prônent une nouvelle génération de jeux en 4K, et même en 8K, mêlant Ray Tracing et Intelligence Artificielle. En attendant que les développeurs en maîtrisent toutes les subtilités techniques pour nous en mettre plein la vue, nous allons nous intéresser ici aux données techniques et à l’architecture de ces machines

Car ces deux consoles, aux conceptions radicalement différentes alors qu’elles sont basées sur les mêmes processeurs AMD, permettent de mieux cerner toutes les technologies qui feront prochainement la différence dans les PC et les stations de travail mais également dans les expériences utilisateurs que les logiciels métiers et les sites Web seront amenés à proposer à l’avenir.

Deux conceptions différentes

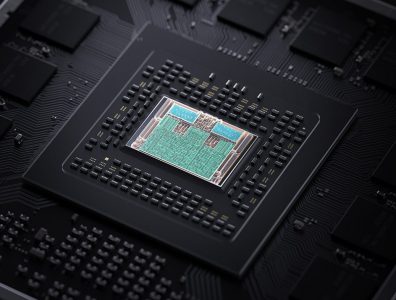

Sur le papier la Xbox Series X et la PS5 sont basées sur les mêmes processeurs : des APU signés AMD à base de cœurs Zen2 et des GPU AMD à architecture RDNA2.

Mais l’implémentation de ces processeurs est radicalement différente dans les deux machines.

Chez Microsoft, la volonté affichée est d’offrir des fréquences fixes ! Pas question ici de faire varier la fréquence en fonction de l’échauffement et de la consommation énergétique.

Chez Microsoft, la volonté affichée est d’offrir des fréquences fixes ! Pas question ici de faire varier la fréquence en fonction de l’échauffement et de la consommation énergétique.

À l’inverse de ce qui se pratique sur les ordinateurs mobiles, Microsoft a fixé les fréquences du CPU et du GPU.

Pour les développeurs, c’est l’assurance de ne pas avoir d’aléas selon la chaleur de la pièce, l’aération de la console, etc.

Pour les joueurs, c’est l’assurance d’un frame rate bien plus constant.

Seule particularité, la fréquence du CPU varie selon que les développeurs choisissent ou non d’activer le multithreading. En mode 8 cœurs single-thread, la partie CPU est cadencée à 3,8 GHz alors qu’en mode 8 cœurs double-thread (16 threads donc), la partie CPU est cadencée à 3,6 GHz.

Le GPU est lui toujours cadencé à 1,825 GHz (un rien plus rapide qu’une NVidia RTX 2080). On est dans du très haut de gamme à un prix bien plus accessible.

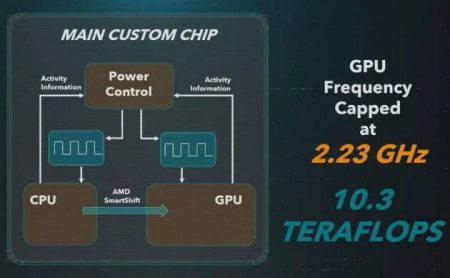

Sony a choisi une approche très différente et a pris des risques. CPU et GPU ont une fréquence variable. Dès lors, lorsque le GPU monte en puissance, le CPU perd en fréquence et inversement (technologie SmartShift d’AMD). Un équilibrage qui sera automatique mais avec lequel les développeurs pourront jouer avec un peu d’astuce. Ainsi la fréquence du CPU pourra monter jusqu’à 3,5 GHz et celle du GPU jusqu’à 2,23 GHz mais les deux ne devraient pas fonctionner simultanément à leur puissance maximale. Toutefois, à 2,23 GHz, le GPU de Sony affiche un pic encore jamais rencontré sur les GPU de PC (tout du moins avant que NVidia ne lance sa nouvelle gamme RTX 30xx).

Sony a choisi une approche très différente et a pris des risques. CPU et GPU ont une fréquence variable. Dès lors, lorsque le GPU monte en puissance, le CPU perd en fréquence et inversement (technologie SmartShift d’AMD). Un équilibrage qui sera automatique mais avec lequel les développeurs pourront jouer avec un peu d’astuce. Ainsi la fréquence du CPU pourra monter jusqu’à 3,5 GHz et celle du GPU jusqu’à 2,23 GHz mais les deux ne devraient pas fonctionner simultanément à leur puissance maximale. Toutefois, à 2,23 GHz, le GPU de Sony affiche un pic encore jamais rencontré sur les GPU de PC (tout du moins avant que NVidia ne lance sa nouvelle gamme RTX 30xx).

Sony explique que « plutôt que de fonctionner à fréquence constante et de laisser la puissance varier en fonction de la charge de travail, nous fonctionnons à une puissance essentiellement constante et laissons la fréquence varier en fonction de la charge de travail. »

À retenir pour les DSI : la nouvelle génération de processeurs AMD promet de décoiffer aussi bien en matière de CPU que de GPU. Les approches de Sony et Microsoft pourraient à terme trouver un écho dans la conception des ordinateurs de bureau, des All-in-One, des mini-PC et des stations de travail. En revanche, elles sont inadaptées à une informatique mobile.

Deux visions du refroidissement

Cette différence architecturale a un impact sur le refroidissement.

Cette différence architecturale a un impact sur le refroidissement.

Contrairement à Microsoft, Sony a retenu les leçons de la PS4 Pro en matière de refroidissement. La variation des fréquences permet de contenir l’échauffement et d’avoir une machine relativement compacte.

Mais Sony assure que « toutes les consoles PS5 traitent les mêmes charges de travail avec le même niveau de performance dans n’importe quel environnement, quelle que soit la température ambiante ». Car Sony ne mesure pas la température du chip mais uniquement l’activité du CPU et du GPU et ajuste leur fréquence en fonction des charges.

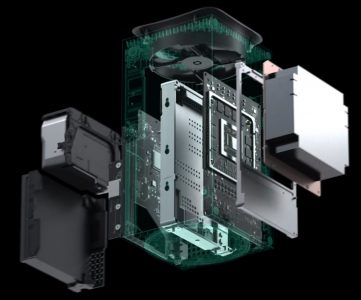

Chez Microsoft en revanche, maintenir à pleine puissance CPU et GPU nécessite un refroidissement très efficace produit par un ventilateur maison spécialement étudié et un design tout en colonne pour mieux diriger le flux d’air chaud vers l’extérieur. La console est assez volumineuse mais peut être indifféremment placée debout ou couchée.

À retenir pour les DSI : Les innovations en matière de refroidissement de Sony et Microsoft pourraient inspirer à terme les constructeurs de mini-PC, de designs embarqués, et de PC « All-In-One » afin de nous offrir des machines bien plus performantes qu’elles ne le sont aujourd’hui.

Du NVMe enfin optimisé

L’un des points les plus étonnants de ces consoles c’est leur adoption de SSD NVMe ! Oui, comme sur les baies Flash les plus performantes du moment. Voire même en mieux !

Là encore deux philosophies s’affrontent.

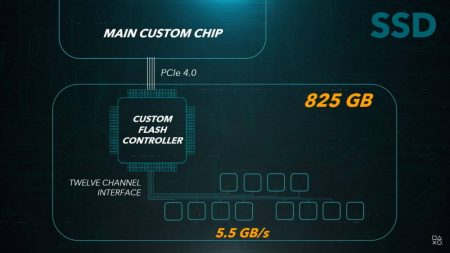

Sony a voulu faire du SSD une force de son architecture de sorte que les développeurs puissent presque l’utiliser comme de la RAM. L’idée n’est pas uniquement d’accélérer les lancements des jeux mais également de permettre aux développeurs d’alimenter les GPU en grosse texture plus rapidement. Apparemment, la PS5 utilise des chips Flash maison dotés d’une interface 12 canaux offrant un taux de transfert de 5,5 Go/sec. En brut et sans compression. C’est impressionnant. Et c’est du jamais vu sur du matériel non professionnel. Des débits rendus possibles par l’adoption d’un bus PCIe 4.0. Cette mémoire Flash est directement reliée à une puce de décompression qui permet donc d’atteindre l’équivalent de 8 Go/sec sans affecter les performances des processeurs ! Un tel débit risque de mettre à rude épreuve les chips Flash et il sera intéressant de voir comment Sony arrive à les refroidir (plus un SSD chauffe, plus ses performances s’effondrent). À noter que Sony a également prévu un slot SSD M.2 pour étendre les capacités de stockage interne de la machine mais les cartes devront être certifiées pour être acceptées (et n’offriront probablement pas la même performance).

Sony a voulu faire du SSD une force de son architecture de sorte que les développeurs puissent presque l’utiliser comme de la RAM. L’idée n’est pas uniquement d’accélérer les lancements des jeux mais également de permettre aux développeurs d’alimenter les GPU en grosse texture plus rapidement. Apparemment, la PS5 utilise des chips Flash maison dotés d’une interface 12 canaux offrant un taux de transfert de 5,5 Go/sec. En brut et sans compression. C’est impressionnant. Et c’est du jamais vu sur du matériel non professionnel. Des débits rendus possibles par l’adoption d’un bus PCIe 4.0. Cette mémoire Flash est directement reliée à une puce de décompression qui permet donc d’atteindre l’équivalent de 8 Go/sec sans affecter les performances des processeurs ! Un tel débit risque de mettre à rude épreuve les chips Flash et il sera intéressant de voir comment Sony arrive à les refroidir (plus un SSD chauffe, plus ses performances s’effondrent). À noter que Sony a également prévu un slot SSD M.2 pour étendre les capacités de stockage interne de la machine mais les cartes devront être certifiées pour être acceptées (et n’offriront probablement pas la même performance).

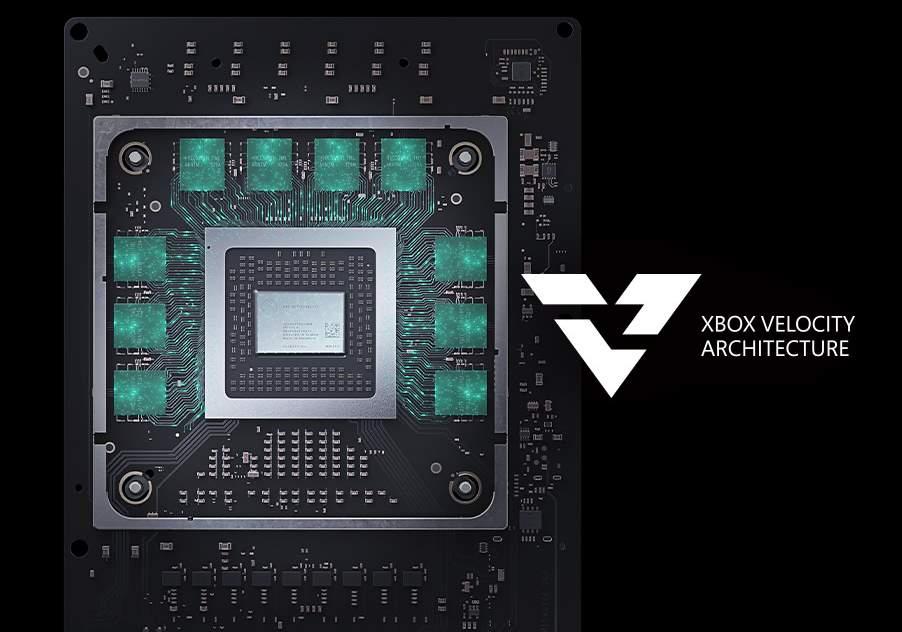

Microsoft a pensé son stockage d’une façon très différente. Il utilise un SSD NVMe avec refroidissement intégré pour assurer des performances constantes et garanties à 2,4 Go/sec, déjà impressionnantes en soi mais deux fois moindres que celles annoncées par Sony. La aussi un chip dédié à la décompression permet d’atteindre un flux d’alimentation en donnée du CPU de l’ordre de 6 Go/sec. Microsoft a ajouté au-dessus ce qu’il appelle la « Velocity Architecture », un jeu d’API qui permet au développeur d’utiliser ce stockage comme une extension mémoire.

Microsoft a pensé son stockage d’une façon très différente. Il utilise un SSD NVMe avec refroidissement intégré pour assurer des performances constantes et garanties à 2,4 Go/sec, déjà impressionnantes en soi mais deux fois moindres que celles annoncées par Sony. La aussi un chip dédié à la décompression permet d’atteindre un flux d’alimentation en donnée du CPU de l’ordre de 6 Go/sec. Microsoft a ajouté au-dessus ce qu’il appelle la « Velocity Architecture », un jeu d’API qui permet au développeur d’utiliser ce stockage comme une extension mémoire.

Le stockage peut être étendu grâce à des cartouches SSD NVMe propriétaires connectées par un bus PCIe et conçues en partenariat avec Seagate. Ces cartouches embarquent un refroidissement.

En outre, Microsoft a incorporé dans son APU un mécanisme très original le SFS (Sampler Feedback Streaming) : si le GPU a besoin d’un peu de temps pour recevoir une texture, il se voit transmettre une texture basse définition le temps des 1 ou 2 frames nécessaires avant que la texture ultra-haute définition ne soit disponible. Ainsi, pas de pertes de frame rates et vos yeux n’y verront probablement rien…

À retenir pour les DSI : Le NVMe se démocratise sur console ! Son avenir est aujourd’hui tout tracé mais on peut s’attendre à des évolutions qui seront en partie sur les chips Flash et sur les interfaces mais aussi sur les pilotes qui gèrent le stockage et sur la façon de présenter ce stockage aux processeurs. Autrement dit, les baies NVMe actuelles sont loin d’avoir atteint leur plein potentiel et des améliorations très significatives devraient voir le jour dans les prochains mois.

En outre, l’interface PCI Express 4.0 va vite se généraliser puisqu’elle est déjà dans ces consoles.

Mieux que du 120 HZ… Le VRR !

Bien plus que l’ultra haute définition, les nouvelles consoles veulent proposer des expériences ludiques plus intenses en soignant le frame rate et en imposant le 60 images par seconde. Le « gameplay » est intimement lié au Frame Rate. comprenez le nombre d’images par seconde. C’est un élément fondamental de toute expérience ludique mais également des expériences comme la réalité virtuelle.

Bien plus que l’ultra haute définition, les nouvelles consoles veulent proposer des expériences ludiques plus intenses en soignant le frame rate et en imposant le 60 images par seconde. Le « gameplay » est intimement lié au Frame Rate. comprenez le nombre d’images par seconde. C’est un élément fondamental de toute expérience ludique mais également des expériences comme la réalité virtuelle.

La fluidité d’une animation dépend en grande partie de ce « frame rate » mais pas seulement : elle dépend aussi et surtout de la capacité du jeu à maintenir un « frame rate » fixe. Le problème, c’est qu’à 60 Hz, un jeu n’a que 16 ms pour générer toute la scène 3D, gérer les entrées/sorties et l’intelligence ludique. Dès que pour une raison ou une autre (scène trop complexe à réaliser ou un GPU qui doit soudain attendre que le CPU ait fini de gérer l’intelligence du jeu), le jeu doit sauter un rafraîchissement d’écran pour dessiner la scène (autrement dit met plus de 16 ms pour calculer la scène), la sensation de fluidité est immédiatement perdue, le jeu passant soudain de 60 images par seconde à 30 images par seconde.

D’où l’idée de ne plus « caller » l’affichage des scènes 3D sur le rafraîchissement d’écran (un concept venu de l’ère du tube cathodique) mais plutôt de faire en sorte que le GPU commande à l’écran le moment du rafraîchissement dès que la scène est prête à être affichée. Ce qui permet aux développeurs de s’aligner sur un frame rate qui laisse plus de temps (45 Hz par exemple).

Cette technologie s’appelle VRR : Variable Refresh Rate. Elle est connue sous le nom de FreeSync chez AMD/Radeon et G-Sync chez NVidia/GeForce. Elle est supportée par la norme HDMI 2.1 et commence à apparaître sur les derniers téléviseurs haut de gamme Samsung, LG et même Sony (qui vient de lancer une gamme de téléviseurs « optimisés pour la PS5 », comprenez compatible VRR).

Xbox Series X et PS5 supportent des technologies VRR. Celle de Microsoft, dénommée VRS, combine à la fois l’aspect VRR et le fait que si l’œil est effectivement sensible aux mouvements à 60Hz il ne perçoit pas les détails. L’architecture Velocity de Microsoft joue sur ce principe pour charger progressivement les textures : plutôt que le GPU doivent attendre qu’une texture soit entièrement chargée pour générer une scène, il se contente d’une version basse définition des textures éloignées et périphériques, le temps que la version haute définition soit en mémoire. Une façon très astucieuse de maintenir la fluidité d’une animation dans tous les contextes.

Xbox Series X et PS5 supportent des technologies VRR. Celle de Microsoft, dénommée VRS, combine à la fois l’aspect VRR et le fait que si l’œil est effectivement sensible aux mouvements à 60Hz il ne perçoit pas les détails. L’architecture Velocity de Microsoft joue sur ce principe pour charger progressivement les textures : plutôt que le GPU doivent attendre qu’une texture soit entièrement chargée pour générer une scène, il se contente d’une version basse définition des textures éloignées et périphériques, le temps que la version haute définition soit en mémoire. Une façon très astucieuse de maintenir la fluidité d’une animation dans tous les contextes.

Ce que les DSI doivent retenir : l’idée de piloter le rafraîchissement de l’écran par le GPU est une amélioration capitale pour la fluidité des animations. La technologie est aussi essentielle pour la réalité virtuelle qui nécessite des fréquences de rafraîchissement supérieure à 90 Hz pour réduire les effets de mal de mer (motion sickness).

Gestion de la mémoire

Un petit mot sur la gestion de la mémoire. Contrairement à la plupart des PC (sauf les machines mobiles à GPU Intel), les deux consoles utilisent une mémoire unifiée GDDR6 à la fois pour le GPU et le CPU.

Un petit mot sur la gestion de la mémoire. Contrairement à la plupart des PC (sauf les machines mobiles à GPU Intel), les deux consoles utilisent une mémoire unifiée GDDR6 à la fois pour le GPU et le CPU.

Sony a joué la carte de la simplicité et intègre 16 Go de mémoire GDDR6 256 bit avec une bande passante de 448 Go/s.

C’est en revanche Microsoft qui a fait preuve d’inventivité ici. La mémoire de 16 Go, montée sur une interface 320 bits, est asymétrique.

Elle se compose de 6 modules de 2 Go offrant 560 Go/s de bande passante (ce qui est assez faramineux) et de 4 modules de 1 Go limités à 336 Go/s.

Cela permet de diminuer les coûts de fabrication.

Charge aux développeurs de s’assurer que toutes les textures et données GPU sont bien stockées dans la mémoire la plus rapide.

À retenir pour les DSI : mémoire, stockage, compute, ce trio forme une équation complexe un peu à la manière du triangle de travail dans une cuisine (préparation, réfrigérateur, cuisson). Les solutions des consoles ne seront pas celles de nos serveurs. Mais elles mettent en lumière les travaux actuels sur les mémoires persistantes et l’Intel Optane ainsi que sur les concepts de « Processing In Memory » et « In Memory Computing ».

Le Raytracing va vite devenir irremplaçable

Sony se montre toujours très réservé sur les capacités RayTracing réelles de sa console se contentant simplement de confirmer que le RayTracing de sa PS5 est équivalent à ce qu’offre la nouvelle génération de GPU RDNA2 d’AMD sur PC.

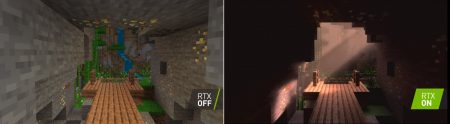

Microsoft en revanche en a fait davantage un atout marketing et technique. Selon les responsables du design de la console, « le travail de Ray Tracing est déchargé sur du matériel dédié au sein du GPU tout en permettant aux shaders de continuer à fonctionner en parallèle et à pleine puissance. En d’autres termes, la série X peut exploiter efficacement l’équivalent de bien plus de 25 TFLOP de performances Ray Tracing ». Le Ray Tracing peut être utilisé pour le rendu de tout ou partie de la scène et permettent des effets de rendus impressionnants comme on a déjà pu le voir sur la version « Ray Tracing » de Minecraft sur PC.

À retenir pour les DSI : le rendu en ray tracing temps réel va se démocratiser. Les utilisateurs vont s’habituer à ces jeux de lumière ultra-réalistes et rechercheront cette qualité de rendu dans leurs interfaces utilisateurs, dans les expériences en réalité virtuelle et dans les expériences de serious gaming.

Au-delà, l’arrivée de la Xbox Series X accompagne également celle de DirectX 12 Ultimate (DX12U) que Microsoft prépare depuis 5 ans déjà et qui supporte des technologies nouvelles au cœur des GPU comme le Raytracing temps réel, le VRS (Variable Rate Shading), les Mesh Shaders, etc. De quoi permettre aux GPU des PC de continuer à évoluer et à tirer les performances graphiques vers le haut aussi bien pour les applications graphiques traditionnelles que pour la réalité mixte.

Intelligence Artificielle

Microsoft a confirmé la présence d’un accélérateur d’inférence s’appuyant sur du Machine Learning en 8 ou 4 bits et offrant une accélération de l’ordre de 97 000 milliards d’opérations par secondes (97 TOPS).

Microsoft a confirmé la présence d’un accélérateur d’inférence s’appuyant sur du Machine Learning en 8 ou 4 bits et offrant une accélération de l’ordre de 97 000 milliards d’opérations par secondes (97 TOPS).

Cette IA pourra être exploitée dans les jeux pour enrichir le comportement des personnages non jouables par exemple.

Mais Microsoft lui a trouvé une autre utilité… Cette IA est exploitée pour traiter en temps réel le rendu des anciens jeux (la console est compatible avec la ludothèque des consoles précédentes) et y émuler un rendu HDR.

En revanche, Sony n’a pas vraiment communiqué de données techniques précises sur les accélérations en matière d’inférence possibles avec sa PS5.

À retenir pour les DSI : l’IA est partout, même dans les consoles, même dans les jeux… Mais ça, vous le saviez déjà. À lire également : L’informatique neuromorphique sort des laboratoires de R&D…

Bref, Sony et Microsoft ont lancé deux monstres de puissance pour les fêtes de fin d’année. Bien évidemment, la prochaine guerre des consoles ne se jouera pas sur les spécifications matérielles. Mais il est toujours amusant et intéressant de voir quelles technologies ces machines adoptent car elles contribueront activement à les démocratiser et en baisser les coûts de fabrication pour nos PC, stations de travail et même nos mobiles. Bien sûr, la bataille se jouera surtout sur les jeux. Toutefois le futur de ces consoles n’est pas forcément écrit d’avance alors que le Cloud Gaming devient chaque jour un peu plus une réalité.

(Article publié à l’origine le 31/07/2020, ré-édité le 24/12/2020)

A lire aussi :

Ce que Google Stadia et Microsoft xCloud peuvent apprendre aux DSI