Data / IA

Arm Everywhere 2026 : quand le roi de la licence devient fabricant de puces

Par Laurent Delattre, publié le 27 mars 2026

C’est le principal enseignement de la grande conférence ARM Everywhere 2026 du concepteur de puces britannique : Arm sort du rôle d’architecte et entre de plain-pied dans la guerre des puces IA. Arm AGI CPU est le premier processeur que l’entreprise vend directement à ses clients en tant que puce physique. Après 35 ans passés à ne commercialiser que de la propriété intellectuelle, Arm entre de plain-pied dans le marché du silicium data center, un virage qui ne manquera pas de redistribuer les cartes…

Le ton était donné dès les premières minutes. « Nous sommes désormais dans un nouveau métier pour Arm : nous vendons des CPU sous forme de puces », a lancé René Haas devant un parterre d’investisseurs, clients et partenaires industriels.

Ironiquement, le CEO d’Arm leur a donc annoncé que son entreprise entrait directement en compétition sur leur terrain… Gloups…

Pour bien mesurer la portée de cette annonce, il faut comprendre le modèle historique d’Arm : l’entreprise concevait des architectures de processeurs sous licence, laissant à ses partenaires – Qualcomm avec les Snapdragon, Apple avec les ‘Apple Silicon’ Axx et Mx, AWS avec Graviton, Microsoft avec Azure Cobalt, Google avec Axion, NVIDIA avec Vera – le soin de concevoir et fabriquer leurs propres puces.

Désormais, Arm propose trois niveaux d’engagement : propriété intellectuelle pure, sous-systèmes de calcul préintégrés (CSS), et puces complètes prêtes à déployer.

L’IA agentique en catalyseur

Officiellement, le message est celui du “choix” offert à l’écosystème. Officieusement, c’est l’aveu que l’ère de l’IA agentique change la chaîne de valeur du datacenter.

Car le premier processeur fabriqué par Arm (dans les usines TSMC), dénommé AGI CPU, est bien d’abord une puce pensée pour l’ère des agents IA.

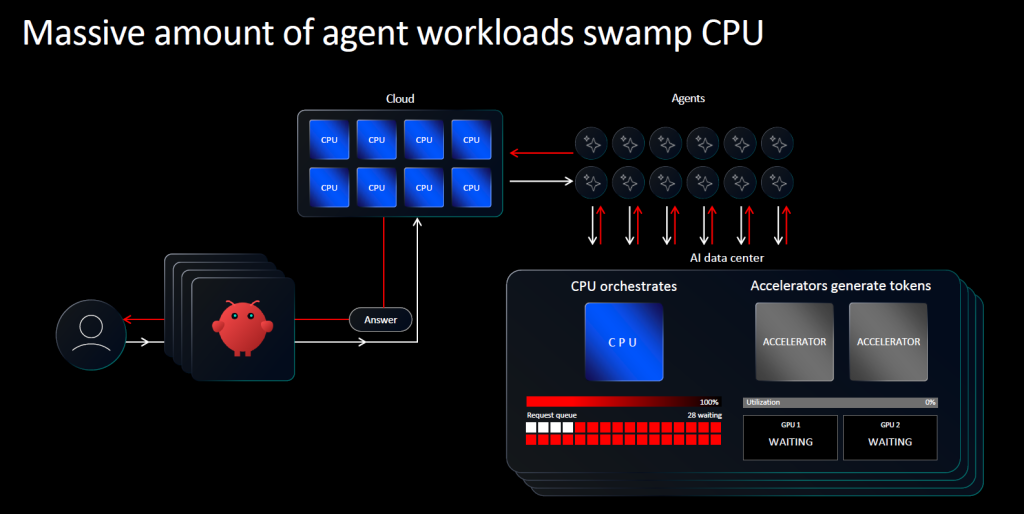

René Haas a consacré une large part de son intervention à décrire l’explosion des besoins en CPU provoquée par l’IA agentique. Dans un centre de données pré-agents, il estimait la densité à environ 30 millions de cœurs CPU par gigawatt. Avec la montée en charge des agents autonomes (qui génèrent des requêtes 15 fois plus nombreuses qu’un humain et fonctionnent 24h/24), ce chiffre grimpe à 120 millions de cœurs pour la même enveloppe énergétique. « Le centre de données étouffe », résume le CEO d’Arm. « L’accélérateur GPU/NPU génère les jetons, mais derrière, il faut bien quelqu’un pour déplacer toute la charge. Ce rôle, ce sont les CPU qui l’assurent, et l’IA agentique ne fait qu’accroître cette pression. »

En un mot, l’IA agentique ne marginalise pas le CPU, elle le réindustrialise !

L’Arm AGI CPU

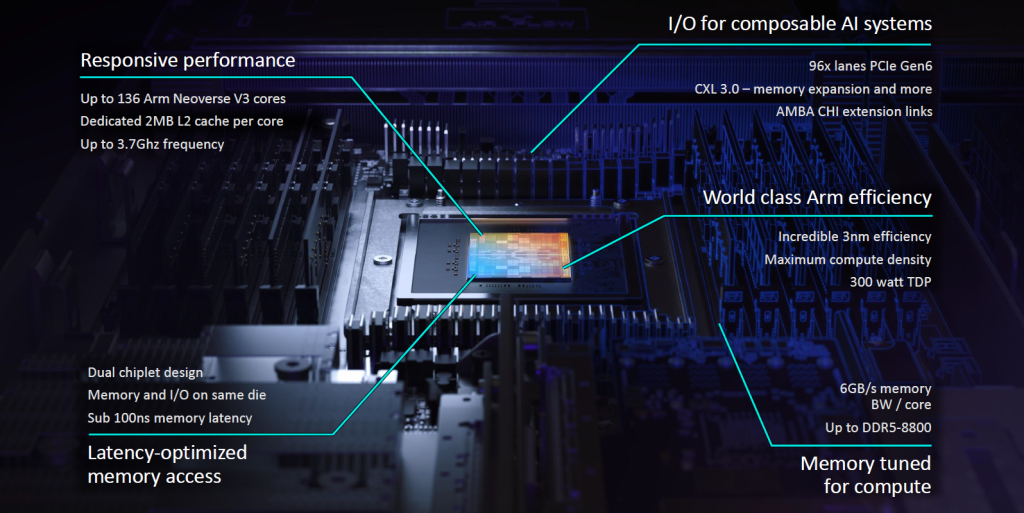

Face à ce goulot d’étranglement, la réponse d’Arm prend la forme d’un système double puce doté de 136 cœurs Neoverse V3, gravé en 3 nm chez TSMC, avec une enveloppe thermique de seulement 300 watts, un chiffre remarquablement bas pour cette classe de performance. La puce intègre 96 lignes PCIe Gen 6 (compatible CXL 3.0), une mémoire DDR5 à 12 canaux offrant jusqu’à 6 Go/s de bande passante par cœur, et une architecture à deux chiplets avec une latence inférieure à 100 nanosecondes.

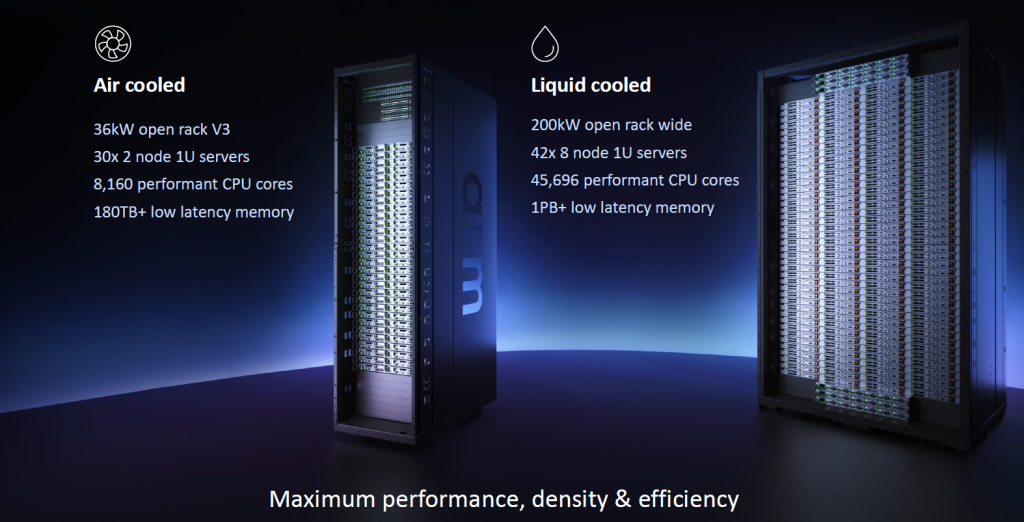

Dans une baie OCP standard refroidie par air de 36 kW, Arm affirme pouvoir loger plus de 8 160 cœurs. En refroidissement liquide à 200 kW, ce chiffre dépasse les 45 000 cœurs. L’entreprise revendique des performances par baie deux fois supérieures aux meilleurs systèmes x86, et signe des temps, c’est l’AMD EPYC, et non l’Intel Xeon, qui sert ici de point de comparaison.

Arm affirme même qu’à l’échelle d’un gigawatt, le différentiel pourrait représenter jusqu’à 10 milliards de dollars de CAPEX évité.

Un bouleversement sur le marché

Mais pourquoi Arm n’agit-il que maintenant ? Selon René Haas, « si Arm fait ce choix aujourd’hui, c’est d’abord parce que ses partenaires le lui ont demandé. »

Pas sûr que le pluriel soit ici très juste. En réalité, un partenaire principal et essentiel se cache derrière cette annonce : Meta. Partenaire de co-développement, la firme raconte avoir cherché sur le marché, pour accompagner ses accélérateurs MTIA, un CPU conciliant performance et efficacité énergétique sans trouver chaussure à son pied.

Au-delà de ce partenariat phare, Arm agit ainsi parce que vendre seulement l’architecture ne suffit plus à capter la valeur créée par l’IA. Jusqu’ici, le groupe prospérait en amont, via les licences et les royalties. En entrant dans le silicium, il remonte d’un cran dans la pile et s’ouvre un marché bien plus large. Jusqu’ici, le marché adressable d’Arm dans le centre de données IA se limitait à environ 3 milliards de dollars de redevances. Avec la vente directe de silicium, ce marché adressable bondit à environ 100 milliards de dollars, soit un multiplicateur de 40x. Arm table sur 15 milliards de dollars de revenus annuels générés par cette seule activité à l’horizon 2031, avec un objectif total de 25 milliards de chiffre d’affaires consolidé, le silicium représentant plus de 60 % du total. Les projections intermédiaires prévoient environ 1 milliard de dollars en 2027-2028, puis 2 milliards en 2029.

Ce n’est donc pas seulement un lancement produit : c’est aussi une narration boursière sur la montée en gamme d’Arm. Et Wall Street ne s’y est pas trompé : le titre a immédiatement bondi de 16%.

Un jeu compliqué… voire risqué… mais…

En devenant fabricant, l’entreprise entre en concurrence frontale avec certains de ses propres licenciés (Apple, Qualcomm, mais aussi AWS, Azure, Google) qui conçoivent déjà leurs puces Arm sur mesure. Le risque de cannibalisation est réel. Pour René Haas, le problème n’existe pas tant le marché est immense : « La demande est si forte qu’aucune entreprise ne peut y répondre seule. »

Et le concepteur britannique prend soin de répéter que les roadmaps IP et CSS vont bien évidemment continuer en parallèle. Ceux qui veulent encore concevoir leur propre silicium conserveront cette voie ; ceux qui veulent aller plus vite pourront acheter directement chez Arm.

La nouvelle stratégie d’Arm s’adresse en réalité à une clientèle différente de celle actuelle : les entreprises et opérateurs cloud qui ne disposent ni des ressources ni de l’expertise pour concevoir leur propre silicium, mais veulent bénéficier de l’efficacité énergétique de l’architecture Arm.

Mais parallèlement, ce lancement intensifie aussi la pression sur AMD et Intel dans les datacenters IA, comme si l’omniprésence de Nvidia et les choix des hyperscalers ne suffisaient pas. Pendant des années, le groupe devait convaincre que l’architecture Arm pouvait exister sérieusement dans le datacenter. Cette bataille semble désormais gagnée : AWS Graviton, Google Axion, Azure Cobalt, NVIDIA Vera et plus de 1,25 milliard de cœurs Neoverse déployés servent de socle aux datacenters IA.

La « performance par rack » des architectures Arm est en train de balayer les acteurs historiques. L’AGI CPU n’est pas un pari de rupture : c’est l’exploitation commerciale d’un écosystème arrivé à maturité, au moment exact où l’IA agentique rend les arbitrages énergétiques décisifs.

Néanmoins, en adoptant ce nouveau statut de vendeur et non plus seulement de concepteur, Arm est peut-être aussi en train d’ouvrir un boulevard à RISC-V.

Au moment même où Arm tenait sa conférence, Alibaba dévoilait en Chine son XuanTie C950, avec un discours sur l’importance des CPU à l’ère agentique qui fait clairement écho à celui d’Arm.

Gravé en 5 nm, le C950 est présenté comme un CPU RISC-V taillé pour le serveur haut de gamme, capable de dépasser les 70 points au SPECint2006 en monocœur et d’exécuter nativement des modèles de plus de 100 milliards de paramètres grâce à des moteurs d’accélération IA intégrés directement au processeur.

Au-delà de la fiche technique, Alibaba met surtout en avant une architecture ouverte, modulaire et sans royalties, plus facile à personnaliser pour les charges agentiques et devenue en Chine un levier explicite de souveraineté technologique face aux ISA propriétaires comme x86 et Arm. Mais ne nous y trompons pas : avec cette annonce, le groupe chinois cherche moins à lancer une puce pour son propre cloud qu’à installer RISC-V comme une alternative crédible dans le datacenter IA face à Arm ! Et n’oublions pas que l’Europe, avec l’initiative DARE, voit aussi RISC-V comme une opportunité de reprendre la main sur son autonomie dans les semi-conducteurs.

Au final, Arm Everywhere 2026 marque moins la naissance d’un nouveau CPU que la fin d’un vieux rôle. Arm n’est plus seulement l’entreprise qui permet aux autres de fabriquer des processeurs. Elle veut désormais leur en vendre, au nom d’une promesse très simple : dans les datacenters IA de demain, la rareté critique ne sera pas seulement le GPU, mais le watt utile autour du GPU. Et sur ce terrain, Arm veut absolument disposer d’une arme à son nom.

La feuille de route est déjà tracée au-delà du premier produit : l’AGI CPU 2 et l’AGI CPU 3 sont annoncés, avec des engagements multigénérationnels de la part des clients. Les feuilles de route IP et CSS restent par ailleurs inchangées, Arm promettant que les enseignements tirés de la conception silicium nourriront l’ensemble de l’écosystème.

Reste qu’avec cette annonce, Arm ne fait pas que changer de modèle économique : il restructure l’échiquier concurrentiel du centre de données IA. Et cela risque de devenir saignant pour certains…

À LIRE AUSSI :