Eco

DeepSeek-Huawei : et si la Chine sortait l’IA de l’orbite Nvidia ?

Par Thierry Derouet, publié le 27 avril 2026

DeepSeek-V4 vient de faire irruption dans la course mondiale à l’IA. Mais l’annonce dépasse le duel des modèles : cette nouvelle génération de DeepSeek est adaptée aux puces Huawei Ascend. Pékin ne prétend pas encore s’affranchir totalement de Nvidia. Il montre autre chose : la Chine assemble sa propre pile IA, des semi-conducteurs aux modèles ouverts, avec l’ambition de faire émerger un standard concurrent. Pour les États-Unis, le risque n’est plus seulement technologique. Il devient économique. Pour l’Europe, il pourrait être existentiel.

Le 24 avril 2026, DeepSeek est sorti du bois. La start-up chinoise, déjà connue pour avoir ébranlé Wall Street avec son modèle R1, a publié la préversion de DeepSeek-V4. Sur le papier, l’annonce ressemble d’abord à une nouvelle étape dans la course aux grands modèles : une version V4-Pro pour les tâches complexes, une version V4-Flash plus rapide et moins coûteuse, un contexte revendiqué d’un million de tokens, et une architecture censée réduire les coûts de calcul et de mémoire. Reuters précise que V4-Pro vise notamment les usages de codage agentique et de programmation compétitive, tout en restant derrière les meilleurs modèles fermés de Google ou d’OpenAI.

Mais l’essentiel n’était pas seulement dans la fiche technique. Il était dans la seconde annonce, presque simultanée. Huawei a indiqué que ses clusters Ascend 950 prenaient en charge DeepSeek-V4. Le modèle serait ainsi adapté aux puces Huawei Ascend. Ces puces auraient contribué à une partie de l’entraînement de V4-Flash. Une précision manque toutefois : DeepSeek ne dit pas clairement si V4-Pro a été entraîné entièrement sans Nvidia. L’autonomie chinoise n’est donc pas prouvée. Elle cesse pourtant d’être une simple incantation.

Quelques jours plus tôt, Jensen Huang avait fourni la clé de lecture. Dans le Dwarkesh Podcast, le patron de Nvidia avait averti : « DeepSeek n’est pas une avancée négligeable. Le jour où DeepSeek sortira d’abord sur Huawei, ce sera un résultat horrible pour notre pays. » La formule ne vise pas seulement le compte de résultat de Nvidia. Elle vise la puissance américaine elle-même.

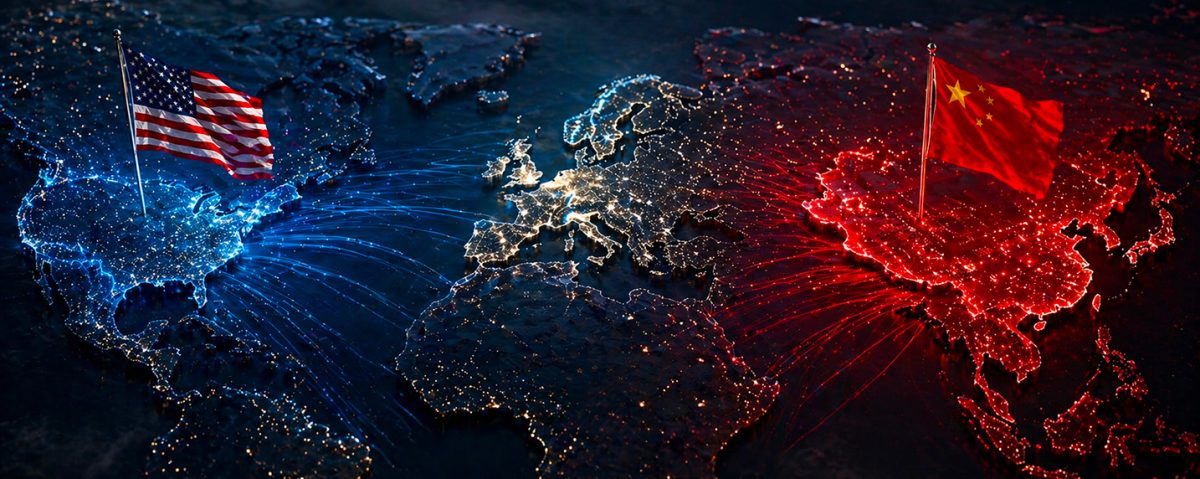

Car la question n’est pas simplement de savoir si DeepSeek-V4 rivalise avec GPT, Gemini ou Claude. Ce serait déjà beaucoup. Mais ce serait encore regarder la scène par le trou de la serrure. La vraie question est plus large : que se passe-t-il si la Chine cesse de courir derrière la pile américaine et commence à construire la sienne ?

Le verrou américain n’était pas seulement la puce

Depuis 2022, Washington cherche à ralentir la Chine en contrôlant l’accès aux semi-conducteurs avancés. Le raisonnement est simple : moins de GPU haut de gamme, moins de calcul ; moins de calcul, moins de grands modèles ; moins de grands modèles, moins de puissance stratégique. Cette logique a produit des effets. Elle a compliqué l’accès chinois aux meilleurs accélérateurs et maintenu Nvidia au centre de l’économie mondiale de l’IA.

Mais une économie technologique ne tient pas seulement par le métal. Elle tient par les gestes, les outils, les habitudes. Nvidia ne vend pas seulement des puces. Nvidia vend un passage obligé : GPU, interconnexions, CUDA, bibliothèques logicielles, clouds partenaires, compétences, documentation, communautés de développeurs. C’est ce que l’on appelle une « pile IA ».

C’est précisément ce passage obligé que la Chine cherche à contourner. Huawei ne pousse pas seulement ses puces Ascend. Il cherche à faire exister un monde où les modèles chinois tournent correctement, puis naturellement, sur une infrastructure chinoise. Et dans l’informatique, le mot « naturellement » est souvent le premier nom de la dépendance.

Huawei reste technologiquement derrière Nvidia. Détourner les développeurs de l’écosystème Nvidia demeure difficile. Il ne faut donc pas raconter une révolution achevée. Il faut raconter un déplacement. La Chine n’a pas besoin de produire immédiatement la meilleure puce du monde. Elle a besoin d’une puce suffisamment performante, disponible localement, intégrée à ses clouds, optimisée pour ses modèles et soutenue par ses développeurs.

Le risque économique : fissurer le péage Nvidia

Pour comprendre pourquoi Jensen Huang parle d’un « résultat horrible », il faut regarder Nvidia non comme un simple fabricant de composants, mais comme un péage mondial de l’IA. En octobre 2025, l’entreprise est devenue la première société à atteindre 5 000 milliards de dollars de capitalisation. Matt Britzman, un analyste chez Hargreaves Lansdown constait alors que voir : « Nvidia atteindre 5 000 milliards de dollars de capitalisation, c’est plus qu’un jalon ; c’est une déclaration, car Nvidia est passée du statut de fabricant de puces à celui de créateur d’industrie. »

Voilà le cœur du risque. Si Nvidia est un créateur d’industrie, DeepSeek-V4 ne menace pas seulement quelques ventes en Chine. Il menace le récit qui soutient une partie de sa valorisation : l’idée que toute IA avancée aura besoin, durablement, de passer par Nvidia.

Le marché n’avait pas attendu la preuve définitive. Il avait réagi à l’hypothèse. Si des modèles moins coûteux produisent des résultats comparables, toute l’économie de l’IA est interrogée : moins de calcul ? moins de data centers ? moins de GPU ? moins de rente Nvidia ? DeepSeek-V4 ajoute une autre question, plus politique encore : et si une partie de cette demande pouvait basculer vers une pile chinoise ?

Dans une entreprise valorisée plusieurs milliers de milliards de dollars, une simple fissure dans le récit peut valoir des centaines de milliards. Les empires financiers ne tombent pas toujours quand les murailles cèdent. Ils vacillent souvent avant, lorsque les investisseurs cessent de croire que les murailles sont éternelles.

CUDA, ce verrou invisible

La puissance de Nvidia ne tient pas seulement à ses GPU. Elle tient à CUDA. Pour filer la métaphore, CUDA est aux puces Nvidia ce que les rails sont au train : on peut construire une autre locomotive, mais encore faut-il disposer du réseau, des aiguillages, des gares, des mécaniciens et des horaires.

Huawei tente de répondre avec CANN, pour Compute Architecture for Neural Networks, son environnement logiciel destiné aux puces Ascend. En septembre 2025, le groupe a annoncé l’ouverture de plusieurs composants clés de cet écosystème, dont des opérateurs CANN et des bibliothèques spécialisées. L’objectif est clair : donner aux développeurs les outils nécessaires pour faire tourner leurs modèles sur Ascend, et ne plus dépendre de CUDA, l’environnement de Nvidia.

Cette phrase a l’air technique. Elle est politique. Celui qui contrôle les outils des développeurs contrôle souvent la suite de l’histoire. Les standards ne naissent pas toujours dans les organismes de normalisation. Ils naissent dans les notebooks, les dépôts de code, les bibliothèques que l’on réutilise sans y penser, les formations que suivent les ingénieurs, les budgets que les DSI reconduisent.

DeepSeek-V4 vient donc rendre visible une stratégie plus large. Il ne s’agit plus seulement d’avoir un modèle. Il ne s’agit plus seulement d’avoir une puce. Il s’agit de relier le modèle, la puce, le logiciel, le cloud, les développeurs et le marché domestique. En informatique, une brique impressionne. Une pile transforme.

Les sanctions américaines, accélérateur involontaire

La stratégie américaine de contrôle des exportations n’est pas absurde. Elle a ralenti la Chine. Elle a rendu plus difficile l’accès aux accélérateurs les plus avancés. Elle a aussi maintenu Nvidia au centre de la compétition mondiale.

Mais les sanctions ont un effet secondaire. Elles ne font pas seulement obstacle. Elles orientent l’effort adverse. En fermant une porte, Washington a obligé Pékin à construire un couloir.

DeepSeek-V4 illustre les efforts chinois pour réduire la dépendance aux technologies étrangères et bâtir un écosystème IA plus autosuffisant. Mais cette autonomie reste incomplète. Huawei reste en retard sur Nvidia, et les coûts de la version Pro ne pourraient baisser qu’à condition de disposer de davantage de grandes grappes de calcul équipées de puces Ascend, capables de faire tourner ces modèles à grande échelle.

La formule tient en une ligne : les sanctions américaines n’ont pas rendu la Chine autonome ; elles lui ont donné une raison impérieuse de le devenir.

L’ouverture, cette arme lente

La Chine ne joue pas seulement la carte des puces. Elle joue celle des modèles ouverts. Là encore, il faut être précis. Dans l’IA générative, l’expression « open source » est souvent employée trop vite. Beaucoup de modèles dits ouverts sont plutôt des modèles à poids ouverts : on peut les télécharger, les adapter, les déployer, mais leurs données d’entraînement et l’ensemble du processus de fabrication ne sont pas nécessairement publiés.

Pour les entreprises, cette nuance n’est pas académique. Un modèle à poids ouverts ne garantit pas automatiquement l’auditabilité, la conformité ou la souveraineté. Mais il donne davantage de prise qu’une API fermée. On peut le tester, le distiller, l’héberger, l’optimiser, le brancher à des applications internes. Surtout, il circule.

C’est cette circulation qui peut faire basculer les standards. Le rapport Stanford HAI-DigiChina publié fin 2025 souligne qu’entre août 2024 et août 2025, les développeurs chinois représentaient 17,1 % des téléchargements de modèles ouverts sur Hugging Face, légèrement devant les développeurs américains à 15,8 %. Le rapport indique aussi qu’en septembre 2025, la famille Qwen d’Alibaba a dépassé Llama pour devenir la famille de grands modèles de langage la plus téléchargée sur Hugging Face.

C’est peut-être le point le plus sous-estimé. Les États-Unis peuvent conserver les modèles fermés les plus puissants. La Chine peut gagner ailleurs : dans les modèles que les développeurs manipulent, adaptent, fine-tunent et embarquent. OpenAI vend l’accès à une boîte noire de très haut niveau. DeepSeek ou Qwen diffusent des briques que d’autres peuvent reprendre. Ce n’est pas la même économie. Ce n’est surtout pas la même stratégie d’influence.

Le séisme possible pour l’économie américaine

L’économie américaine de l’IA repose aujourd’hui sur une hypothèse simple : les modèles vont réclamer toujours plus de calcul, donc toujours plus de puces, donc toujours plus de data centers, donc toujours plus d’énergie, donc toujours plus de dépenses d’infrastructure. Nvidia est le cœur battant de cette chaîne.

C’est pourquoi l’hypothèse d’une pile chinoise crédible pèse plus lourd qu’un simple lancement de modèle. Si DeepSeek, Huawei, CANN, Qwen et les clouds chinois finissent par former un écosystème cohérent, le risque n’est pas que Nvidia disparaisse. Le risque est que le marché commence à appliquer une décote au péage. Une partie de la demande chinoise pourrait basculer vers Huawei. Une partie des pays émergents pourrait préférer des modèles ouverts, moins coûteux et moins dépendants des arbitrages de Washington. Une partie des entreprises pourrait choisir non le modèle le plus brillant, mais la pile la plus maîtrisable économiquement et politiquement.

L’Europe et le rachat d’Aleph Alpha par le canadien Cohere

Reste l’Europe. Il serait injuste de la dire immobile. Elle a déjà posé son cadre réglementaire avec l’AI Act, dont les obligations applicables aux modèles d’IA à usage général sont entrées en vigueur le 2 août 2025. La Commission a aussi publié, le 10 juillet 2025, un Code de bonnes pratiques destiné à aider les fournisseurs de modèles généralistes à démontrer leur conformité. Autrement dit, l’Europe sait produire de la règle, et même une grammaire de confiance.

Elle tente aussi de construire la puissance de calcul qui lui manque. Le plan européen « AI Continent » revendique 200 milliards d’euros pour stimuler le développement de l’IA, dont 20 milliards pour financer jusqu’à cinq gigafactories. Ces infrastructures doivent être jusqu’à quatre fois plus puissantes que les AI Factories existantes et servir à entraîner des modèles complexes. À côté, l’Union européenne a établi 19 AI Factories et 13 antennes destinées à fournir gratuitement de la puissance de calcul et de l’accompagnement aux PME et aux start-up.

L’Europe n’est donc pas sans briques. Elle a des supercalculateurs via EuroHPC, des acteurs cloud, des laboratoires, des industriels, des financements publics, et des modèles comme ceux de Mistral AI. La start-up française a levé 1,7 milliard d’euros en septembre 2025, avec ASML comme chef de file, pour une valorisation post-money de 11,7 milliards d’euros. Mistral présente cet apport comme un moyen de pousser la recherche scientifique et de répondre aux défis technologiques des industries stratégiques.

Mais une somme ne fait pas une pile. C’est là que le bât blesse. L’Europe dispose d’éléments épars : la règle, le calcul, quelques modèles, des clouds, des chercheurs, des industriels. Elle n’a pas encore assemblé un écosystème aussi lisible que Nvidia-CUDA-OpenAI-Microsoft côté américain, ni une trajectoire aussi intégrée que Huawei-Ascend-CANN-DeepSeek-Qwen côté chinois. Dans cette bataille, la puissance ne vient pas seulement de l’existence de chaque brique. Elle vient de leur alignement.

L’annonce du rachat d’Aleph Alpha par le canadien Cohere, le 24 avril dernier, donne à cette fragilité un visage concret. Aleph Alpha avait longtemps été présentée comme l’un des espoirs allemands de l’IA générative. Reuters rapporte que Cohere détiendrait environ 90 % de l’entité combinée, contre 10 % pour les actionnaires d’Aleph Alpha, tandis que le groupe Schwarz, maison mère de Lidl et Kaufland, investirait 600 millions de dollars dans le prochain tour de table de Cohere. L’opération vise à bâtir une offre d’IA souveraine pour les secteurs régulés (administrations, finance, santé, énergie, télécoms, défense) mais elle rappelle aussi une vérité inconfortable : lorsqu’un champion européen doit changer d’échelle, son centre de gravité peut vite sortir d’Europe.

Le paradoxe européen est là. L’Europe veut une IA de confiance, mais les piles techniques qui s’imposent se construisent ailleurs. Elle finance des infrastructures, mais les marchés, les développeurs et les modèles dominants restent tirés par les États-Unis ou, désormais, par une Chine qui avance ses propres standards. Elle parle de souveraineté, mais l’adossement d’Aleph Alpha à Cohere montre que la souveraineté industrielle ne se décrète pas : elle se finance, s’industrialise, se distribue, s’héberge et se maintient dans la durée.

Justin Hotard, le CEO de Nokia, l’a résumé brutalement : « Le problème aujourd’hui, c’est que l’Europe n’a pas l’infrastructure. » Il avertit que, sans infrastructures robustes, les entreprises et les développeurs iront là où elles existent déjà, principalement aux États-Unis ou en Chine.

L’agentique, c’est l’enjeu pour un DSI

C’est là que le sujet quitte la géopolitique pour revenir dans le SI. L’IA agentique ne sera pas un module de plus posé au-dessus des applications. Elle a vocation à devenir une couche d’orchestration : lire des documents, appeler des API, générer du code, déclencher des workflows, dialoguer avec l’ERP, le CRM, les outils de cybersécurité ou les bases documentaires.

Pour un DSI, le choix ne portera donc pas seulement sur le « meilleur modèle » du moment. Il portera sur la pile à laquelle il accepte de raccorder ses processus métiers. Car celui qui contrôle cette couche ne contrôle pas seulement une réponse générée par une IA. Il contrôle les chemins par lesquels les données circulent, les actions sont déclenchées, les décisions sont préparées et, demain, une partie du travail est exécutée.

C’est pourquoi DeepSeek-V4 dépasse le duel entre Pékin et Washington. Il rappelle que la bataille de l’IA ne se jouera pas seulement dans les laboratoires ou sur les marchés financiers. Elle se jouera aussi dans les architectures d’entreprise. Là où les DSI devront décider, très concrètement, s’ils bâtissent leurs futurs agents sur une pile américaine, chinoise, européenne ou sur une combinaison suffisamment maîtrisée pour ne pas devenir captifs d’un standard qu’ils n’auront pas choisi.

Open source ou open weight ?

Dans l’IA générative, l’expression « open source » est souvent utilisée de manière trop large. Un modèle pleinement open source devrait publier assez d’éléments pour permettre sa reproduction : code, architecture, méthode d’entraînement, données ou documentation détaillée.

Beaucoup de modèles dits ouverts sont plutôt des modèles à poids ouverts, ou open weight. Leurs paramètres sont disponibles, ce qui permet de les utiliser, de les adapter ou de les déployer. Mais les données d’entraînement et l’ensemble du processus de fabrication restent souvent fermés.

Pour les DSI, la différence est importante. Un modèle à poids ouverts peut réduire la dépendance à une API propriétaire. Il ne garantit pas automatiquement transparence complète, auditabilité totale, conformité ou souveraineté juridique.

À LIRE AUSSI :