Data / IA

Google et le MIT posent les bases d’une science du multi-agents IA

Par Laurent Delattre, publié le 06 mars 2026

C’est un effet de bord encore méconnu et mal maîtrisé : la multiplication des agents IA qui collaborent entre eux dégrade les performances des systèmes agentiques. Des chercheurs de Google et du MIT posent les premiers jalons d’une véritable science du scaling agentique et proposent un framework capable d’indiquer à l’avance quelle architecture choisir et dans quels cas il est préférable de se satisfaire d’un agent unique !

Google n’est certainement pas novice en matière de systèmes multi-agents. Le géant de Mountain View est l’un des pionniers du sujet et a déjà beaucoup investi dans la compréhension et la structuration de ces architectures où plusieurs modèles de langage collaborent pour accomplir des tâches complexes. L’éditeur est d’ailleurs à l’origine d’un des protocoles agentiques clés du moment, le protocole open source A2A (Agent-To-Agent), qui permet à des agents IA potentiellement développés par des organisations différentes, avec des frameworks différents, de communiquer, collaborer et se coordonner entre eux.

Fin 2025, Google a également publié un guide de référence remarqué décrivant huit design patterns essentiels pour les systèmes multi-agents, accompagné d’exemples concrets pour son Agent Development Kit.

Cette fois, des chercheurs de Google Research, de Google DeepMind et du MIT se sont attaqués à un problème, un défi, encore en dehors du radar des DSI mais qui ne le restera pas bien longtemps : ils proposent un cadre prédictif quantitatif capable de déterminer, avant même le déploiement, quelle architecture multi-agent convient le mieux à une tâche donnée et surtout, quand il vaut mieux ne pas y recourir du tout.

Le mythe du « plus d’agents, c’est toujours mieux »

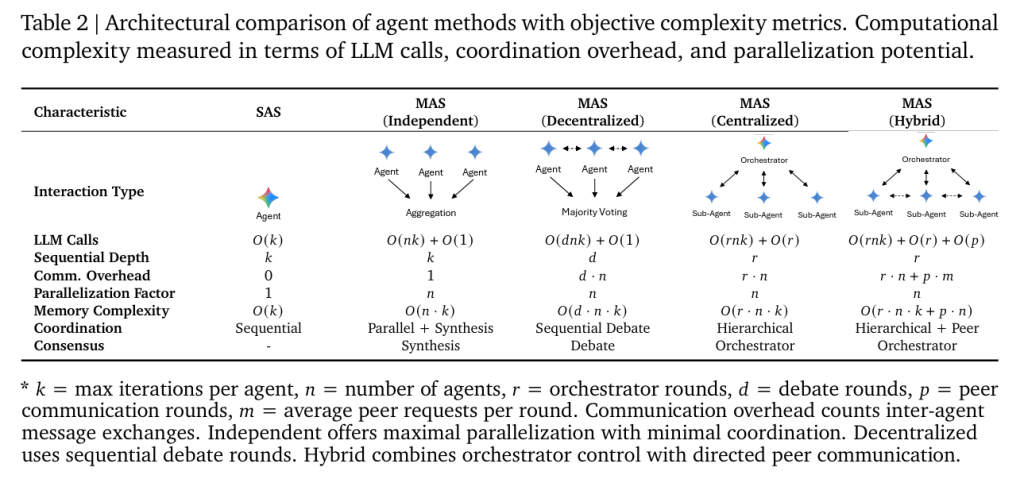

L’idée selon laquelle multiplier les agents IA améliore mécaniquement les résultats a longtemps dominé la R&D en IA agentique. L’étude, intitulée « Towards a Science of Scaling Agent Systems », bat en brèche cette croyance. En évaluant 180 configurations différentes sur quatre benchmarks couvrant la finance, la navigation web, la planification dans un environnement de jeu (Minecraft) et l’exécution de tâches bureautiques, les chercheurs montrent que les résultats vont de +81 % d’amélioration à -70 % de dégradation par rapport à un agent unique. Autrement dit, le multi-agent n’est pas une recette universelle : c’est un levier qui peut se retourner contre vous si l’architecture ne correspond pas à la nature de la tâche.

Sur Finance-Agent, une tâche facilement décomposable en sous-problèmes parallèles, la coordination centralisée améliore les performances de 80,9 % par rapport à un agent unique. À l’inverse, sur PlanCraft, benchmark de planification séquentielle où chaque étape dépend étroitement de la précédente, toutes les variantes multi-agents testées dégradent les résultats, avec des baisses allant de 39 % à 70 %. Sur BrowseComp-Plus, consacré à la navigation web dynamique, l’architecture décentralisée fait mieux que la centralisée dans les résultats principaux, avec un gain de 9,2 % contre 0,2 %, ce qui suggère qu’un espace d’exploration plus distribué est mieux adapté à ce type d’environnement.

Trois effets dominants identifiés

L’étude met en lumière trois phénomènes clés. Le premier est un compromis entre outils et coordination : lorsqu’une tâche nécessite de nombreux outils, le surcoût de coordination entre agents consomme le budget de calcul au détriment du raisonnement utile. Les auteurs citent explicitement les environnements bureautiques riches en outils, y compris des scénarios à 16 outils, comme zone de fragilité pour le multi-agent.

Le deuxième est un effet de saturation : dès qu’un agent unique atteint environ 45 % de réussite sur une tâche, ajouter des agents supplémentaires produit des rendements décroissants, voire négatifs.

Le troisième concerne l’amplification des erreurs selon la topologie : dans une architecture où les agents travaillent de manière indépendante sans se vérifier mutuellement, les erreurs se multiplient par un facteur 17. En revanche, une architecture centralisée, où un orchestrateur supervise et valide les résultats, contient cette amplification à un facteur 4,4.

La tâche dicte l’architecture, pas l’inverse

L’un des résultats les plus frappants est la dépendance totale au type de tâche. L’analyse financière, par nature décomposable en sous-problèmes parallèles (analyse des revenus, des coûts, des tendances de marché), bénéficie massivement d’une coordination centralisée avec un gain de plus de 80 %.

La navigation web dynamique, qui requiert une exploration diversifiée, tire mieux parti d’une architecture décentralisée où les agents échangent entre pairs.

En revanche, la planification séquentielle, où chaque action dépend du résultat de la précédente, souffre systématiquement du multi-agent, quelle que soit l’architecture choisie, avec des dégradations allant de 39 % à 70 %.

Il faut toutefois éviter d’en faire une loi absolue : sur certaines validations hors échantillon avec des modèles plus récents, l’écart entre centralisé et décentralisé tend à se resserrer.

Un modèle prédictif opérationnel

Le cœur de la contribution scientifique réside dans un modèle de régression à 20 paramètres qui combine la capacité du modèle de langage sous-jacent, les propriétés de la tâche (nombre d’outils, performance de base en agent unique) et des métriques de coordination mesurées empiriquement (efficacité, surcoût, redondance, densité de messages, amplification d’erreurs). Ce modèle atteint un R² d’environ 0,52 en validation croisée et prédit l’architecture optimale dans 87 % des cas sur des configurations jamais vues à l’entraînement. On reste donc dans un cadre prédictif utile, mais pas dans une science exacte.

Validé après coup sur GPT-5.2, un modèle publié après la fin de la campagne expérimentale initiale, le framework confirme quatre des cinq principes fondamentaux avancés par les auteurs. La nuance importante est que cette validation reste partielle et ciblée, pas une réplication complète de tous les résultats sur tous les benchmarks. Elle renforce néanmoins l’idée que plusieurs lois dégagées par l’étude se généralisent aussi à des modèles de nouvelle génération.

Et demain ?

Les chercheurs sont les premiers à pointer les limites de leur travail. Les environnements à forte intensité d’outils restent un point faible majeur pour la coordination multi-agent, et des protocoles spécialisés (ordonnancement d’accès aux outils, routage selon les compétences) restent à inventer. Comme le résume Google dans son billet de blog accompagnant l’étude, des modèles fondamentaux plus puissants ne remplacent pas le besoin de systèmes multi-agents : ils l’accélèrent, mais uniquement quand l’architecture est adaptée à la structure réelle de la tâche.

Ainsi l’étude acte au final un tournant dans la manière d’aborder les systèmes agentiques. Jusqu’ici, le secteur vivait sur des intuitions, des patterns et beaucoup d’essais-erreurs. Ce travail propose un changement de régime : passer d’une culture de la recette à une culture de la mesure. Et il rappelle une évidence que l’euphorie autour des agents avait tendance à faire oublier : dans l’IA agentique aussi, la complexité n’est pas gratuite. Ajouter des agents ne rend pas automatiquement un système plus intelligent. Dans bien des cas, cela peut surtout le rendre plus lourd, plus coûteux et moins fiable.

À LIRE AUSSI :

À LIRE AUSSI :