ChannelScope

Nutanix Agentic AI : quand l’infrastructure devient le vrai sujet de l’IA en entreprise

Par Vincent Verhaeghe, publié le 17 mars 2026

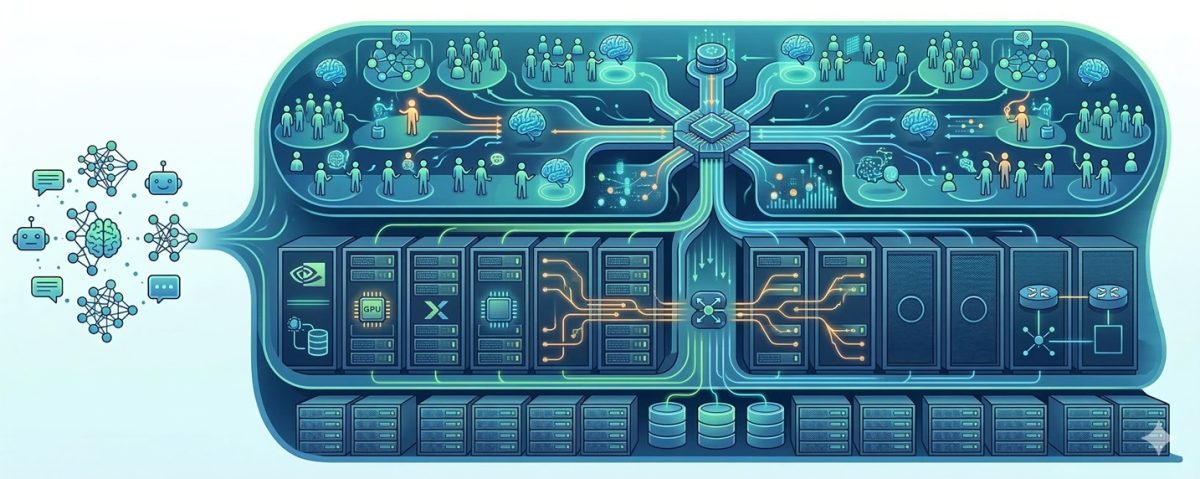

Faire tourner un agent IA en démo, c’est une chose. En faire fonctionner des milliers simultanément, en production, avec des contraintes de sécurité et de conformité réelles, c’en est une autre. C’est précisément ce gouffre que Nutanix entend combler avec Nutanix Agentic AI, une pile logicielle full-stack annoncée ce 17 mars lors du Nvidia GTC de San Jose.

Pendant des mois, les entreprises ont investi dans des modèles de langage, construit des chatbots, expérimenté des outils Copilot. Résultat : des démonstrations convaincantes, mais des déploiements laborieux. Ce que les équipes IT ont découvert en chemin, c’est que le modèle n’était pas le problème, c’est souvent l’infrastructure qui l’est.

« Contrairement aux infrastructures d’IA destinées à l’entraînement des modèles, optimisées pour exécuter une seule grande tâche, les infrastructures d’IA agentique en production doivent gérer l’échelle et un rythme élevé de changements pour des milliers de services d’IA, d’agents et d’utilisateurs et développeurs simultanés », résume Thomas Cornely, Executive Vice President of Product Management chez Nutanix.

Ce diagnostic, les équipes IT des grandes entreprises le partagent. Les chatbots conversationnels ont fait leur temps en tant que vitrine technologique. Ce qui se profile maintenant, c’est une génération d’agents capables de raisonner sur des tâches complexes, d’agir de façon autonome et de poursuivre des objectifs à long terme avec peu ou pas de supervision humaine. Ce changement de régime appelle une infrastructure radicalement différente et un modèle économique qu’on peut effectivement maîtriser.

Trois couches, un objectif : réduire le coût par token

La solution s’organise en trois niveaux qui s’emboîtent. En surface, les services PaaS IA et la plateforme Kubernetes. La version 2.6 de Nutanix Enterprise AI (NAI) intègre désormais une AI Gateway pour piloter de façon unifiée les politiques d’accès aux LLM, qu’ils soient hébergés dans le cloud ou en environnement privé. Le support du Model Context Protocol (MCP) server et du fine-tuning complète le tableau, permettant aux agents de se connecter de manière sécurisée aux outils et sources de données internes. La plateforme Kubernetes conforme CNCF embarque quant à elle un catalogue d’outils open source, notebooks, bases de données vectorielles, moteurs MLOps, frameworks agentiques, avec une intégration complète à Nvidia AI Enterprise pour un déploiement instantané des microservices Nvidia NIM, dont la famille Nemotron.

En dessous, c’est la couche infrastructure et sécurité qui fait le travail de fond. L‘hyperviseur AHV, disponible en accès anticipé dans une version topology-aware, optimise automatiquement l’allocation des ressources GPU sur les serveurs à forte densité. Flow Virtual Networking décharge le dataplane réseau vers Nvidia BlueField, ce qui se traduit concrètement par des performances réseau plus élevées et une consommation CPU/mémoire allégée sur les hôtes. Résultat direct : un meilleur contrôle du coût par token, qui reste la mesure la plus parlante pour évaluer l’économie d’un déploiement IA agentique à grande échelle.

À la base, Nutanix Unified Storage s’appuie sur l’architecture de référence Nvidia AI Data Platform pour offrir des performances d’entrées/sorties extensibles pour des milliers de clients GPU, avec support de S3 over RDMA et NFS over RDMA. Nutanix figure par ailleurs parmi les partenaires qui co-conçoivent la prochaine génération d’infrastructures IA basée sur Nvidia STX, l’architecture de référence BlueField-4 STX annoncée simultanément au GTC.

Nvidia, Dell, Cisco : une coalition qui parle aux intégrateurs

Ce qui distingue cette annonce d’un simple lancement produit, c’est l’écosystème qu’elle mobilise. Nutanix et Nvidia travaillent ensemble sur l’intégration du Nvidia Agent Toolkit, incluant le runtime open source Nvidia OpenShell, pour poser les fondations des agents autonomes en entreprise.

« L’intégration par Nutanix du Nvidia Agent Toolkit et des modèles ouverts Nemotron offre aux entreprises une base solide pour construire et exploiter des usines d’IA efficaces, et nous travaillons ensemble pour développer l’IA autonome en entreprise à mesure que les agents évoluent », confirme Justin Boitano, Vice President Enterprise AI Platforms chez Nvidia.

Du côté de Dell, le message est direct. « Nous aidons les entreprises à se concentrer sur la création d’applications d’IA qui apportent une véritable valeur métier, plutôt que sur la gestion de la complexité opérationnelle », déclare dans le communiqué Travis Vigil, Senior Vice President ISG Product Management chez Dell Technologies. Cisco, de son côté, insiste sur la dimension opérationnelle : « Un environnement clé en main et sans friction, dans lequel les organisations peuvent déployer leurs usines d’IA avec la résilience, la sécurité et la cohérence du cycle de vie qu’exigent leurs environnements d’entreprise », décrit Jeremy Foster, SVP and General Manager Cisco Compute.

Ces usines d’IA certifiées par Nvidia peuvent être déployées sur du matériel Cisco, Dell et Supermicro, validé conjointement par Nutanix et Nvidia, ce qui donne aux intégrateurs une liste de configurations supportées sur lesquelles s’appuyer.

Disponibilité et suite

La solution regroupe des produits déjà en disponibilité générale et d’autres actuellement en accès anticipé, dont la disponibilité complète est attendue prochainement. Pour les revendeurs et intégrateurs qui veulent creuser le sujet, le prochain rendez-vous à noter est le .NEXT 2026 de Nutanix, à Chicago du 7 au 9 avril, où la stratégie IA complète du groupe sera détaillée.

À LIRE AUSSI :

À LIRE AUSSI :