Data / IA

OpenAI lance GPT-Image 2.0 et relance la bataille de la création visuelle par IA

Par Laurent Delattre, publié le 22 avril 2026

OpenAI a lancé cette nuit GPT-Image 2.0, la toute nouvelle mouture de son modèle IA de génération d’images dont les précédentes versions ont de multiples fois fait parler d’elles et sont rapidement devenues virales sur les réseaux sociaux par leur capacité à reproduire le style des studios Ghibli ou encore à vous transformer en figurine « Starter Pack » sous Blister.

Pourtant depuis la version 1.5, le modèle a commencé à trouver ses usages en entreprise malgré ses limites en termes de formats d’image et de résolution et des défauts typiques des IA génératives d’images (aberrations visuelles, déformations des polices et des lettres, difficulté à conserver un même style ou des mêmes personnages d’une image à l’autre, etc.).

Aussi l’annonce de GPT-Image 2.0 alors que se joue actuellement l’Adobe Summit 2026, mais aussi à la veille de l’ouverture de la conférence Google Cloud Next, n’est, elle, pas forcément fortuite. D’autant qu’à Las Vegas, Adobe a présenté CX Enterprise, sa nouvelle plateforme agentique de bout en bout pour piloter l’ensemble du cycle client, ainsi que GenStudio, sa chaîne de production de contenus reliant contexte d’entreprise, intelligence de marque, agents IA et workflows de planification, création, activation, diffusion, reporting et analyse. Surtout, Adobe assume désormais l’idée que ces chaînes doivent fonctionner au-dessus d’un écosystème ouvert de modèles et d’agents, incluant Anthropic, Google, Microsoft et… OpenAI. Autrement dit, le marché n’est plus seulement celui du “beau visuel”. Il devient celui de l’orchestration créative à l’échelle pour illustrer les campagnes marketing sur tous les canaux.

GPT-Image 2.0 arrive dans un moment où les directions marketing ne cherchent plus uniquement un outil d’illustration, mais un moteur capable de produire des visuels exploitables dans de vrais flux de travail : affiches, infographies, planches éditoriales, contenus multilingues, assets publicitaires, séries cohérentes d’images, et à terme contenus pilotés par des agents. La System Card fournie par OpenAI confirme d’ailleurs cette bascule : son modèle gagne en connaissance du monde, en suivi des instructions, en production de détails complexes comme du texte dense, et son mode thinking ajoute raisonnement et usage d’outils.

Un marché de l’IA visuelle devenu hyper-concurrentiel

En deux ans, le paysage de la génération d’images par IA a basculé d’une curiosité de laboratoire à un marché mature où une demi-douzaine d’acteurs se disputent le marché. Google pousse très fort sa famille Nano Banana / Gemini Image, avec un positionnement natif multimodal, de l’édition conversationnelle, du raisonnement, des visuels ancrés dans des données réelles, du texte lisible et des workflows avancés de cohérence entre personnages et références. Midjourney reste, lui, une référence sur la finition visuelle, les textures et la cohérence esthétique, avec V7 et ses fonctions comme Draft Mode et Omni Reference. Ideogram demeure particulièrement agressif sur le texte dans l’image, le réalisme et les styles cohérents. Black Forest Labs, avec FLUX.1 Kontext, reste très fort sur l’édition et la transformation d’images par instruction. Adobe Firefly 3 tient son différenciant sur la sécurité juridique : entraîné exclusivement sur des données licenciées, il offre une indemnisation commerciale complète très recherchée par les directions juridiques d’entreprises. Même Microsoft dispose de son propre modèle maison « MAI Image 2.0 » pour servir les besoins de Bing, de Copilot et autres outils maison.

La bataille des modèles IA d’image se joue à la fois sur l’esthétique, les capacités d’édition, le texte et l’intégration dans des workflows métiers.

Les améliorations majeures : le texte, le raisonnement, la cohérence

OpenAI présente Images 2.0 comme un « step change » plutôt que comme une simple itération. Les axes d’amélioration sont multiples et cohérents. Des améliorations qui interpelleront immédiatement les équipes créatives puisque le modèle se veut à l’état de l’art en termes de typographie, de support multilingue, de continuité de scènes. Il est capable de construire des bandes dessinées, des planches éditoriales, des affiches, des compositions à plusieurs formats, voire des visuels quasi prêts pour l’impression. OpenAI insiste aussi sur la capacité du modèle à traiter des prompts complexes et à produire des images plus structurées, plus exploitables et plus fidèles à l’intention.

Le rendu typographique, premier champ de bataille

C’est probablement le saut le plus visible. Les modèles d’image échouaient traditionnellement dès qu’il fallait produire du texte lisible à l’image, un travers fatal pour le marketing, le branding, le design d’interfaces ou la production d’infographies. Selon les premiers tests indépendants, Images 2.0 approche 99 % de précision typographique. Le modèle gère désormais les petites polices, les pictogrammes, les éléments d’UI, les compositions denses et les contraintes stylistiques subtiles – avec une résolution allant jusqu’à 2K via l’API.

Une avancée spectaculaire sur les écritures non latines

OpenAI revendique des gains particulièrement marqués sur le japonais, le coréen, le chinois, le hindi et le bengali. C’est un verrou majeur qui saute pour les campagnes internationales, la publicité localisée, les posters multilingues et les bandes dessinées (manga, manhwa). Un argument lourd pour les marques internationales, les éditeurs et les agences opérant sur les marchés asiatiques.

Des ratios et formats prêts à l’emploi

Images 2.0 supporte des ratios de 3:1 (ultra-large) à 1:3 (ultra-haut), couvrant bannières web, slides de présentation, posters, écrans mobiles, marque-pages et graphiques sociaux. Objectif explicite d’OpenAI : réduire la post-production (et le recours à Photoshop pour corriger ou recadrer) et produire des actifs directement utilisables dans la chaîne de diffusion.

La rupture majeure : un modèle image qui raisonne

Pour la première fois, OpenAI embarque ses capacités de raisonnement (dérivées de GPT 5.4 Thinking) dans un modèle d’image. Baptisé Thinking mode, ce dispositif active en coulisse :

* Une recherche web en temps réel, utile pour générer des infographies factuelles, des affiches citant des données d’actualité ou des visuels référencés.

* La capacité à utiliser des outils ce qui lui confère un côté agentique.

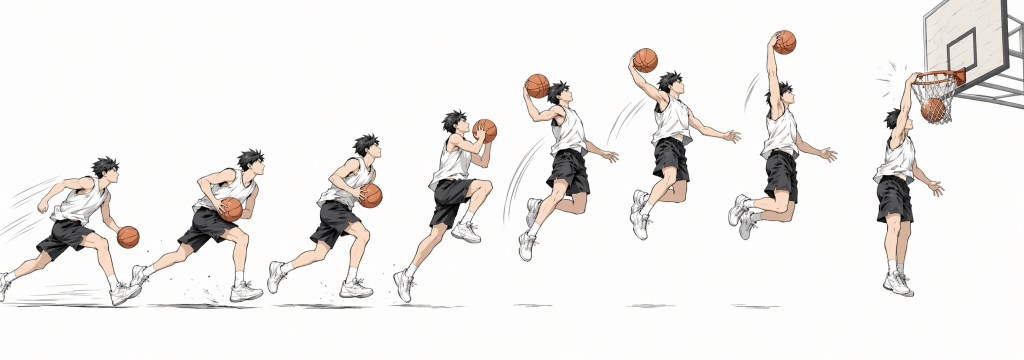

* La génération de jusqu’à 8 images cohérentes en une seule requête, avec continuité de personnages, d’objets et de style.

* Une auto-vérification des sorties : le modèle contrôle qu’il a bien répondu au brief avant de livrer.

Cette mécanique ouvre la porte à des cas d’usage jusqu’ici laborieux : storyboards complets, campagnes multi-formats, planches de manga, guides pédagogiques illustrés, design exploratoire itératif, le tout depuis un prompt unique.

Une intégration Codex inattendue

Images 2.0 est disponible dans Codex, l’environnement de codage agentique d’OpenAI, désormais ouvert sur tous les usages enterprise. Les développeurs peuvent ainsi générer maquettes, prototypes d’UI et iconographie sans quitter leur workspace, ni gérer de clé API séparée. OpenAI veut transformer Codex en « superapp » multi-fonctions, brouillant délibérément la frontière entre IDE, suite bureautique agentique et studio créatif.

Knowledge cutoff porté à décembre 2025

Le modèle hérite d’une connaissance du monde à jour, ce qui permet de générer des visuels référencés sur des produits, des marques ou des événements récents sans passer systématiquement par la recherche web.

La System Card confirme que GPT-Image 2.0 bénéficie d’une connaissance du monde nettement enrichie, d’un bien meilleur respect des consignes et d’une capacité accrue à gérer le détail et la complexité, notamment le texte dense. Pour les métiers du marketing et de la communication, c’est probablement là le vrai saut. Une IA d’image qui sait produire une belle illustration impressionne. Une IA capable de générer un visuel lisible, cohérent, typographiquement crédible, multilingue, adaptable à plusieurs formats et pilotable par un agent devient une composante d’infrastructure métier. C’est cette bascule qui rapproche GPT-Image 2.0 du terrain d’Adobe, de GenStudio et plus largement des futures usines à contenus.

Les limites reconnues par OpenAI

L’éditeur n’esquive pas, et c’est appréciable, les angles morts du modèle. Ils concernent principalement trois domaines :

Le raisonnement physique précis. Les tâches qui exigent une compréhension fine du monde physique (origami, pliages complexes, certains puzzles) continuent de poser problème au modèle.

Les textures extrêmement denses ou répétitives. Le modèle peut décrocher sur des patterns très complexes (comme des grains de sable) ou des scènes saturées.

Les diagrammes très détaillés. OpenAI admet que les schémas techniques complexes peuvent nécessiter une relecture humaine. Un point à intégrer dans les workflows de type documentation technique ou publication scientifique.

Par ailleurs, les sorties supérieures à la résolution 2K ne sont disponibles que via l’API et sont encore en bêta. OpenAI prévient que sur les résolutions plus élevées les résultats peuvent se révéler inconsistants.

La lecture de la System Card révèle également d’autres limites. La plus importante étant en réalité le revers de sa puissance : le gain en réalisme accroît le risque de deepfakes plus convaincants, y compris sur des personnes, des lieux ou des événements réels, avec des implications politiques, sexuelles ou sensibles. La System Card dit explicitement que ce surcroît de réalisme crée de nouveaux risques et justifie des garde-fous supplémentaires.

Ce que nous apprend la System Card

Pour en savoir plus sur les garde-fous et les limites des sécurités embarquées, il faut se plonger dans la System Card publiée par OpenAI. On y apprend que la chaîne de sécurité du modèle repose sur trois contrôles successifs : un classifieur texte qui filtre les prompts en amont (couche prompt), un modèle de raisonnement multimodal (couche image) qui contrôle les inputs texte et image, et ce même modèle qui réanalyse l’image finale avant livraison.

Les chiffres de l’évaluation adversariale – menée sur des prompts spécifiquement conçus pour générer du contenu violant les politiques d’alignement du modèle – sont révélateurs.

En mode Instant, 22 % des générations sont jugées non conformes par le grader d’OpenAI. La couche image en rattrape 87,3 %, la couche prompt 77,2 %, et leur union 96,1 % – pour un taux final de sorties sûres de 99,1 %.

Le Thinking mode inverse la logique de protection : au lieu de générer puis filtrer, il réécrit les prompts adverses en requêtes conformes avant toute génération (logique de Safe Completions). La conséquence est mesurable : seulement 6,7 % d’images problématiques produites à la source, contre 22 % en Instant, et un taux final de sorties sûres de 99,2 %.

Reste un angle mort à intégrer dans les politiques IA enterprise : 3,9 % des images violantes échappent aux filtres en mode Instant, et 12,5 % en mode Thinking. Des chiffres tirés d’une évaluation adversariale, pas d’un trafic réel, mais qui rappellent qu’une seule dérive peut coûter cher en image de marque.

La vraie surprise vient du Preparedness Framework, le fameux cadre interne qu’OpenAI s’est auto-imposé pour tracker et anticiper les capacités des modèles risquant de porter préjudice. L’éditeur classe désormais Images 2.0 comme « high capability » sur le risque biologique, après qu’une expertise externe a confirmé que le modèle pouvait générer des infographies assez précises pour apporter un « novice uplift » sur des sujets sensibles – biotoxines notamment. Une politique de sécurité image-spécifique a été déployée en conséquence. Pas de risque significatif en revanche sur les volets cyber et auto-amélioration, faute de capacité à générer du code exécutable.

Côté provenance (autrement dit les moyens de vérifier qu’une image provient bien d’une IA), OpenAI consolide son dispositif autour de deux briques complémentaires. D’une part, le standard ouvert C2PA (Content Credentials) via le Conformance Program : chaque image embarque des métadonnées cryptographiquement signées identifiant son origine IA.

D’autre part, un watermark statistique invisible et robuste intégré dans les pixels eux-mêmes, conçu pour survivre au recadrage, à la compression et au changement de format – avec un outil de détection interne côté OpenAI. L’investissement répond à trois pressions : l’article 50 de l’AI Act qui imposera dès août 2026 le marquage des contenus synthétiques ; les litiges en cours sur les données d’entraînement ; et la demande enterprise croissante d’une piste d’audit démontrable pour les actifs IA utilisés commercialement.

Reste qu’aucun dispositif de provenance n’est infaillible. Un watermark robuste peut être affaibli par une série de manipulations ciblées (réencodage profond, inpainting étendu, passage par un autre modèle). C2PA, lui, peut être effacé simplement en prenant une capture d’écran. OpenAI le reconnaît explicitement dans sa System Card : « il n’existe pas de solution unique à la provenance ». La valeur du dispositif réside moins dans son imperméabilité absolue que dans la présence d’un signal détectable dans la grande majorité des cas d’usage.

Déploiement, accès et tarification

GPT-Image 2.0 est disponible dès aujourd’hui sur ChatGPT, sur Codex et sur la plateforme API d’OpenAI.

Côté ChatGPT, le modèle GPT Image 2.0 est disponible immédiatement pour tous les utilisateurs. Les capacités Thinking (raisonnement, recherche web, génération multiple) sont réservées aux abonnés Plus, Pro, Business et Enterprise et sont activées dès que l’utilisateur spécifie « Thinking » ou « Pro » dans l’interface de l’assistant.

Côté Codex, le modèle est désormais intégré nativement, sans clé API séparée pour les abonnés ChatGPT, avec une ouverture particulière sur les usages enterprise via Codex Labs.

Enfin, côté API, le modèle est disponible sous le nom « gpt-image-2 ». Il est facturé 8 $ par million de tokens image en entrée et 30 $ par million de tokens en sortie, auxquels s’ajoutent 5 $ et 10 $ par million de tokens texte (input/output).

Le retour d’OpenAI au sommet

Avec GPT-Image 2.0, OpenAI signe clairement son retour au sommet des classements de l’IA créative. Alors que le pionnier de l’IA générative a semblé récemment très bousculé voire dépassé par Anthropic, son nouveau modèle vient rappeler qu’OpenAI reste un innovateur qui peut encore surprendre et faire progresser considérablement ses modèles frontières.

GPT-Image 2.0 n’impressionne pas seulement par la qualité de ses rendus. Il frappe par sa polyvalence : texte dans l’image, respect des consignes, cohérence visuelle, raisonnement, recherche web, sécurité, traçabilité. Ce n’est plus juste un générateur d’illustrations bluffant. C’est un moteur de production visuelle. Dans les chaînes créatives et marketing, un tel modèle ne sert plus seulement à “faire une image”. Il produit des variantes, adapte des campagnes, génère des visuels localisés, accélère les cycles de création et automatise une partie croissante du travail graphique. GPT-Image 2.0 montre qu’OpenAI n’a rien perdu de sa capacité à émerveiller et à dominer la future usine à contenus dopée à l’IA agentique du marketing des entreprises.

La balle est désormais dans le camp de Google qui ouvre ce soir sa grande conférence Google Cloud NEXT 2026.

À LIRE AUSSI :

À LIRE AUSSI :