Cloud

Google Cloud Next 2026 (Partie 3) : Vers une cybersécurité agentique

Par Laurent Delattre, publié le 28 avril 2026

La conférence Google Cloud Next 2026 a sans doute été l’édition la plus dense jamais orchestrée par l’hyperscaler, avec 260 annonces. Au-delà de la nouvelle plateforme agentique et de la refonte de l’infrastructure sous-jacente, l’éditeur a aussi livré une pile cybersécurité entièrement remaniée pour faire face à la fois aux attaques accélérées par l’IA et aux risques inédits introduits par les agents autonomes. Décryptage de ce qui s’apparente à une nouvelle doctrine cyber, dans laquelle la frontière entre IA et sécurité s’estompe.

Les deux premières parties de notre compte rendu de Google Cloud Next 2026 (ici et ici) ont décrit la mécanique applicative et matérielle d’une entreprise désormais conçue pour fonctionner avec des flottes d’agents IA. Côté plateformes, Vertex AI s’est mué en Gemini Enterprise Agent Platform, véritable cockpit pour construire, exécuter, gouverner et optimiser les agents, avec quatre piliers (Build, Scale, Govern, Optimize), une refonte d’Agentspace en Gemini Enterprise App, et un Workspace Intelligence qui transforme la suite collaborative en tissu sémantique pour agents et copilotes.

Pour soutenir cet univers agentique, Google Cloud fait évoluer son infrastructure Cloud sous-jacente. L’hyperscaler a fait le choix d’un découplage radical entre entraînement et inférence, avec deux nouvelles puces dédiées : le TPU 8t pour entraîner les modèles de demain et le TPU 8i pour servir des millions d’agents en production. La fabrique réseau Virgo Network relie 134 000 TPU dans un même datacenter et plus d’un million sur plusieurs sites, tandis que l’Agentic Data Cloud (Cross-Cloud Lakehouse, Knowledge Catalog, Data Agent Kit) se charge d’alimenter les agents en contexte métier de qualité.

Mais toute cette pile s’effondrerait rapidement sans son ultime socle : la sécurité. Car en multipliant les agents, les protocoles MCP, les délégations d’identité et les communications de machine à machine, l’entreprise agentique élargit considérablement sa surface d’attaque. Les modèles eux-mêmes deviennent des cibles, les prompts des vecteurs, et les agents des identités non-humaines à part entière qu’il faut authentifier, autoriser et tracer. En parallèle, l’attaquant met lui aussi l’IA à son service.

C’est précisément cette nouvelle équation que Google a tenté d’adresser avec une troisième salve d’annonces. Voici ce que DSI et RSSI doivent en retenir.

22 secondes pour réagir

Selon le rapport M-Trends 2026 publié par Mandiant en marge de la RSA Conference, les délais de réaction se sont littéralement effondrés : le temps qui sépare un accès initial du transfert vers un acteur secondaire dans la chaîne d’attaque est passé de huit heures il y a trois ans à seulement vingt-deux secondes aujourd’hui. Vingt-deux secondes, c’est moins que le temps qu’il faut à un analyste SOC pour ouvrir un ticket et lire la première ligne de contexte.

On le sait tous aujourd’hui, les attaquants se sont professionnalisés comme un véritable écosystème d’entreprises, avec des spécialistes de l’accès initial qui revendent leur intrusion à des opérateurs de ransomware, eux-mêmes adossés à des affiliés négociateurs et à des plateformes de paiement. À cela s’ajoute désormais l’IA : génération de logiciels malveillants automatisée, vishing à grande échelle, attaques adaptatives capables de réécrire leur propre code en temps réel, deepfakes, etc.

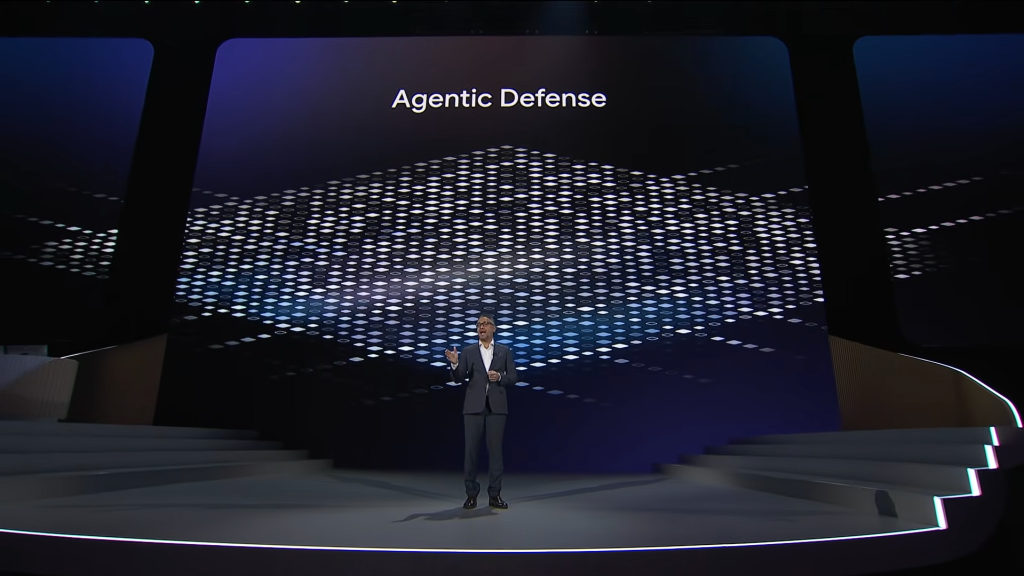

Face à ces machines à attaquer, l’humain ne suffit plus. Il faut des défenseurs qui agissent à la même vitesse. Tout l’enjeu de l’Agentic Defense que Google a placée au centre de sa stratégie pour 2026 est là : opposer à l’attaque automatisée une défense automatisée, agentique et nourrie d’un renseignement sur la menace de très grande échelle (Mandiant, Google Threat Intelligence, signaux issus de l’écosystème Google et de son observatoire planétaire de menaces).

Agentic Defense : Google Security Operations passe à l’offensive

C’est le cœur du dispositif. Google Security Operations (le SIEM/XDR/SOAR managé issu de Chronicle et enrichi par Mandiant, désormais étoffé d’intégrations Wiz) accueille trois nouveaux agents IA, qui viennent compléter le « Triage and Investigation Agent » déjà en production.

Le Threat Hunting Agent (en preview) part en chasse de manière proactive sur des schémas d’attaque inédits et sur les comportements furtifs qui échappent aux détections traditionnelles. L’idée : ne plus attendre qu’une règle déclenche une alerte, mais explorer en permanence le contexte, en s’appuyant sur l’historique d’incidents Mandiant et sur les signaux faibles agrégés par Google.

Le Detection Engineering Agent (également en preview) s’attaque à un goulot d’étranglement bien connu des SOC : la rédaction des règles de détection. L’agent identifie les zones de couverture lacunaires, propose et teste de nouvelles détections, et fait basculer la création de règles d’un artisanat manuel à une logique semi-industrialisée.

Enfin, le Third-Party Context Agent, qui devrait suivre dans les semaines qui viennent en preview, vient enrichir les enquêtes avec des données contextuelles issues de sources tierces. C’est la couche qui doit permettre à l’analyste d’arrêter le ping-pong entre Wiz, l’IdP, la télémétrie runtime et les outils de threat intel pour obtenir, en un seul écran, le contexte dont il a besoin.

Surtout, ces trois nouveaux agents s’ajoutent au Triage and Investigation Agent déjà en production qui, selon Google, a traité plus de cinq millions d’alertes au cours de l’année écoulée et compressé une analyse manuelle classique de trente minutes à une minute environ, soit un facteur trente. Une statistique à manier avec la prudence d’usage qui sied aux mesures internes d’un éditeur mais qui dessine néanmoins l’horizon vers lequel se dirigent les SOC : un triage de niveau 1 entièrement automatisé, des analystes recentrés sur les enquêtes complexes et la chasse, et un « mean time to respond » (MTTR, ou délai moyen de réponse) divisé par un ou deux ordres de grandeur.

L’éditeur étoffe également son arsenal de renseignement avec Dark Web Intelligence, en preview dans Google Threat Intelligence. Capable, selon Google, d’analyser quotidiennement des millions d’événements externes avec une précision de 98 % pour faire remonter les menaces qui comptent vraiment, cette brique vient potentiellement marcher sur les plates-bandes des spécialistes du cyber threat intelligence indépendants.

Côté ouverture, la prise en charge MCP distante pour Google Security Operations passe en disponibilité générale, et un client MCP est désormais accessible directement depuis l’interface de chat de la plateforme. Concrètement, ce support MCP permet à un RSSI de brancher ses propres agents (Claude Code Security, agents internes maison, agents partenaires) sur la donnée Google SecOps.

Wiz, désormais bras armé multicloud de Google Cloud Security

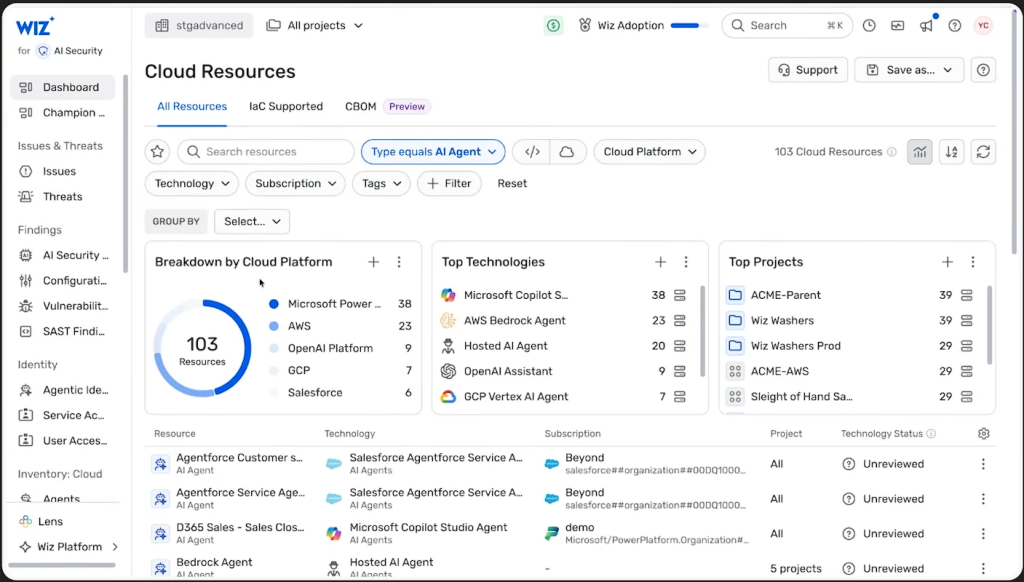

Ce Google Cloud Next 2026 a aussi été l’occasion pour l’hyperscaler de réaliser la première vraie démonstration de force de sa dernière acquisition, Wiz, qui lui a coûté la bagatelle de 32 milliards de dollars. L’éditeur israélien devient la couche multicloud de la stratégie sécurité de Google, avec une couverture étendue à AWS, Azure, Oracle Cloud, OpenAI et même les environnements « auto-hébergés ».

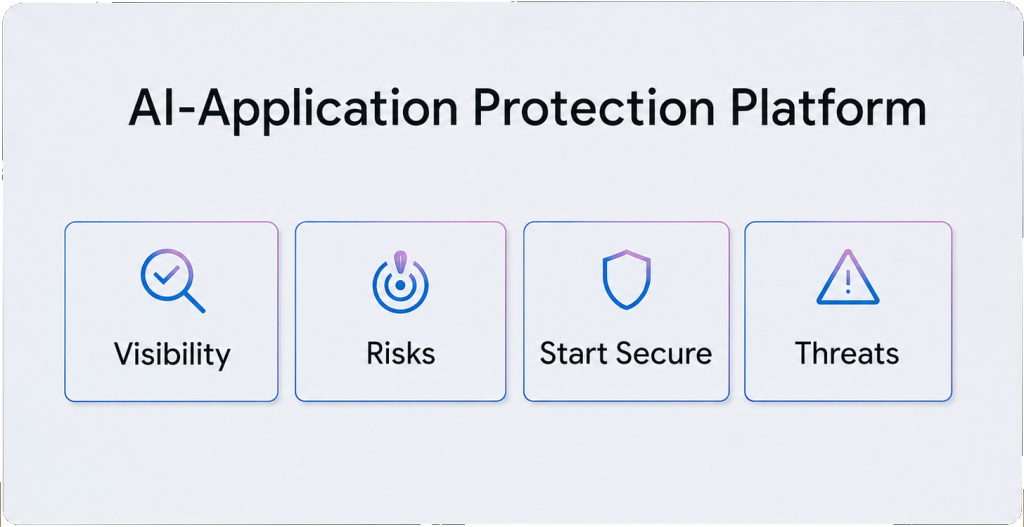

Présentée il y a quelques semaines à la RSA Conference, AI-APP (AI-Application Protection Platform) est la nouvelle plateforme de Wiz dédiée à la protection des applications IA. Elle apporte trois choses concrètes : une cartographie complète de ce qui tourne dans l’environnement IA de l’entreprise, une évaluation continue du niveau de risque associé, et une analyse en temps réel des comportements suspects pendant l’exécution des modèles et des agents.

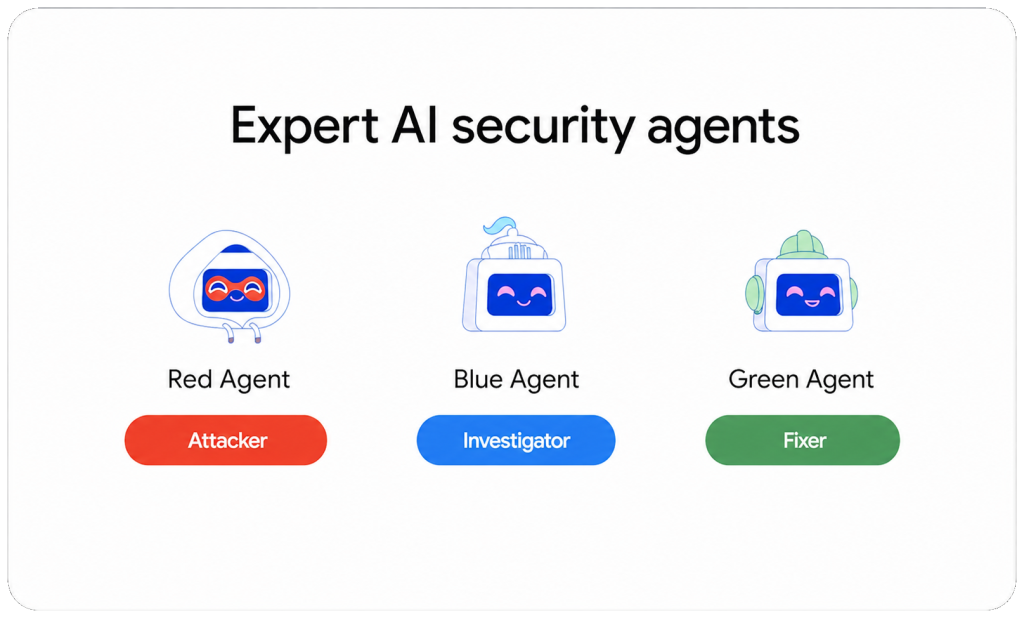

Cette plateforme s’appuie désormais sur deux nouvelles briques. D’un côté, les Wiz Security Agents, déclinés en trois familles inspirées des exercices de cybersécurité offensive : les agents red simulent des attaques pour éprouver les défenses, les agents blue surveillent et défendent en continu, et les agents green veillent à la conformité et au respect des politiques. De l’autre, les Wiz Workflows, qui orchestrent automatiquement les actions à mener dès qu’un risque est détecté, sans attendre l’intervention humaine (sauf si le risque l’exige).

Avec cet ensemble, Wiz illustre une nouvelle tendance forte de la cybersécurité 2026 : ne plus se contenter de détecter les problèmes, mais aussi les corriger de manière autonome grâce à des agents IA. Une évolution majeure pour les plateformes de type CNAPP (Cloud-Native Application Protection Platform, l’arsenal cloud de protection des applications natives), qui jusqu’ici se concentraient surtout sur la détection et laissaient la remédiation à la charge des équipes humaines.

Dans le même temps, le périmètre défensif de Wiz s’élargit considérablement. La plateforme prend désormais en charge Databricks, mais surtout les principaux agent studios du marché — autrement dit les ateliers de création d’agents IA proposés par les grands éditeurs : AWS Agentcore chez Amazon, Gemini Enterprise Agent Platform chez Google, Microsoft Azure Copilot Studio chez Microsoft et Salesforce Agentforce chez Salesforce. Le message sous-jacent est clair : peu importe l’outil retenu par les équipes pour fabriquer leurs agents, Wiz offre une console de pilotage unique. Le tout s’appuie sur la fameuse cartographie Security Graph maison, qui relie en permanence les identités, les ressources, les données et les permissions de l’entreprise pour faire ressortir les chemins d’attaque possibles.

L’éditeur étend par ailleurs ses intégrations à ce qu’il appelle la « couche externe du cloud », c’est-à-dire les services qui exposent les applications sur Internet : la plateforme de gestion d’API Apigee côté Google, mais aussi le service de protection IA Cloudflare AI Security for Apps et la plateforme d’hébergement Vercel. Enfin, les détections produites par Wiz Defend, la brique de surveillance temps réel de Wiz, s’intègrent désormais nativement à Google Security Operations et à Mandiant Threat Defense. Concrètement, lorsqu’un risque est repéré dans le cloud, l’information bascule automatiquement vers les outils du SOC, sans plus avoir à configurer manuellement les passerelles entre produits.

Du vibe coding au shadow AI : Wiz attaque les nouveaux angles morts de l’IA

Aussi importantes que soient les annonces ci-dessus, c’est sur le terrain du cycle de vie de développement que Wiz signe son virage le plus net. Avec l’irruption massive des assistants IA dans les IDE et la généralisation du vibe coding, de nouvelles surfaces de risque sont apparues là où la cybersécurité historique ne regardait pas. Alors, Wiz s’y attaque sur quatre fronts.

Premier front, la sécurisation du vibe coding. Une nouvelle intégration, attendue en mai, fait tourner les scans Wiz directement à l’intérieur de la plateforme Lovable, l’un des champions du genre. Vulnérabilités, secrets et erreurs de configuration remontent dans le panneau de sécurité intégré de Lovable, là où le développeur travaille effectivement, sans qu’il ait besoin de basculer sur un outil tiers.

Deuxième front, la sécurisation du code généré par IA, qu’il sorte d’un assistant comme Copilot, Gemini Code Assist ou Claude Code. Des hooks de sécurité IA s’enclenchent directement dans les IDE et dans les workflows d’agents pour analyser à la volée les prompts soumis à l’assistant et le code qu’il renvoie, posant des garde-fous avant tout commit. Une réponse directe à un risque désormais bien documenté : l’IA, même sous supervision humaine, produit volontiers du code vulnérable (clés en dur, requêtes SQL non préparées, validation d’entrées absentes) que les pipelines classiques ne détectent que tardivement, voire jamais.

Troisième front, la remédiation pilotée par les agents. Jusqu’ici, tout agent codeur (Codex, Claude Code, Cursor, GitHub Copilot, Gemini Code Assist…) travaille un peu dans sa bulle : il voit le code, mais pas comment ce code, une fois déployé, expose l’entreprise (quelles ressources cloud il touche, quelles données il manipule, quelles failles il ouvre). Pour offrir aux agents codeurs une vue à 360° sur les conséquences réelles, en production, du code qu’ils écrivent, Wiz lance Wiz Skills. La nouvelle brique branche les agents et les IDE natifs IA sur le Security Graph maison, la cartographie qui relie en permanence identités, ressources, données et permissions à travers tout le cloud de l’entreprise. Résultat : dès qu’une vulnérabilité est détectée, l’agent ne se contente plus de la signaler, il dispose du contexte nécessaire pour la corriger lui-même. Le correctif peut s’appliquer ponctuellement, dans l’IDE du développeur, ou se propager à l’échelle d’un dépôt entier via une pull request automatisée qui répare le problème partout où il se niche.

Quatrième front, le shadow AI. Wiz introduit une AI-BOM (AI Bill of Materials) dynamique, autrement dit une nomenclature vivante qui inventorie automatiquement les frameworks IA, modèles et extensions IDE déployés dans l’environnement de développement. L’objectif : suivre les outils IA autorisés tout en débusquant les plugins IA non approuvés qui se sont insinués dans la chaîne de dev. Un sujet brûlant, à l’heure où les analyses post-incident montrent régulièrement que des extensions VS Code ou des assistants IA non gouvernés ont siphonné du code propriétaire ou des secrets corporate.

Sécuriser les agents eux-mêmes : Agent Identity, Agent Gateway, Model Armor

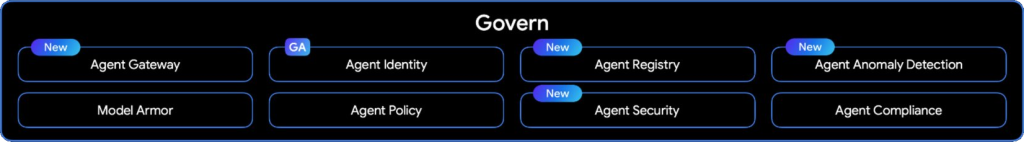

Google place désormais la gouvernance des agents au cœur de la Gemini Enterprise Agent Platform, un point qu’il convient de relire à la lumière de la première partie de notre compte rendu, où nous présentions le pilier « Govern » de la plateforme. Trois briques concentrent l’essentiel de la nouvelle doctrine.

Agent Identity attribue à chaque agent un identifiant cryptographique unique, ses propres flux d’authentification et un périmètre de délégation humaine bien défini. Pour Google, l’identité non-humaine devient un périmètre à part entière et l’IAM doit désormais évoluer vers un agentic identity management, qui traite les agents IA comme des acteurs numériques distincts, dotés de leurs propres identités managées. Car les approches IAM classiques, conçues pour des humains qui se connectent quelques fois par jour, doivent être profondément repensées pour tenir face à des milliers d’agents qui s’authentifient à la milliseconde.

La brique Agent Gateway joue le rôle de tour de contrôle aérien : elle impose les politiques sur toutes les connexions agent-vers-agent et agent-vers-outil, comprend les protocoles MCP et Agent2Agent (A2A), inspecte le trafic et le sécurise. Google a d’ailleurs annoncé que la Gateway pourrait s’adosser à un cercle de partenaires pour étendre ses capacités : Broadcom, Check Point, Cisco, CrowdStrike, Exabeam, F5, Netskope, Okta, Palo Alto Networks, Ping Identity, Saviynt, Silverfort, Thales et Zscaler. La preview est annoncée pour les semaines qui viennent. C’est, en creux, la reconnaissance que la fabrique de communication agentique va devenir aussi sensible que l’est aujourd’hui le contrôleur de domaine Active Directory.

Enfin, Model Armor, la brique Google de protection runtime des interactions modèles et agents, étend ses tentacules. Elle s’intègre désormais à Agent Gateway, à Agent Runtime, à LangChain (les trois en préversion), ainsi qu’à Firebase (en GA). L’objectif : permettre aux développeurs d’enclencher inspection et désinfection en ligne du trafic agentique sans modifier le code. Model Armor protège contre le triptyque désormais bien identifié des risques runtime : prompt injection, empoisonnement d’outils et fuite de données sensibles.

Le tout s’inscrit dans la promesse de Google de vous aider à bâtir des agents secure-by-design et d’empêcher, de manière préventive, ce que les analystes appellent désormais le reasoning drift : la dérive d’un agent par rapport à ses instructions, qu’elle soit causée par un prompt malveillant ou par un contexte injecté à la volée. Une dérive que le nouveau module « Agent Anomaly Detection » doit repérer et éviter.

Le web agentique sous surveillance : Cloud Fraud Defense et Chrome Enterprise

Au-delà des agents internes à l’entreprise, Google s’attaque à un sujet plus subtil : la sécurité du web agentique, autrement dit les interactions entre les agents externes (ceux des clients, des partenaires, ou plus prosaïquement des bots scraping) et les services Web de l’entreprise.

Première annonce structurante, la transformation de reCAPTCHA en Google Cloud Fraud Defense. Plus question de se contenter de filtrer les bots des humains : la plateforme se donne pour mission d’arbitrer la légitimité et l’autorisation des bots, des humains et des agents IA. Bientôt, des fonctionnalités spécifiques aux agents seront proposées en preview, capables de sécuriser le parcours de commerce numérique de bout en bout (création de compte, connexion, paiement, validation). Une réponse directe à un sujet brûlant. Avec l’arrivée d’agents IA capables de piloter un navigateur à la place de l’utilisateur, les sites marchands voient débarquer une nouvelle catégorie de visiteurs : ni des humains à proprement parler, ni des bots malveillants. Ces agents naviguent, comparent, ajoutent au panier et finalisent l’achat pour le compte d’un client réel. La question n’est donc plus seulement « est-ce un humain ou un robot ? », mais « cet agent agit-il bien au nom d’un client autorisé, et faut-il le laisser passer commande ? ». Un captcha binaire ne suffit plus à y répondre.

Deuxième pan : Chrome Enterprise se dote de nouveaux contrôles spécifiquement orientés IA. Des AI-aware extension threat detections (en preview) remontent une télémétrie avancée sur les extensions, permettant aux équipes sécurité de repérer les comportements anormaux d’agents IA dans le navigateur. Et un nouveau dispositif de shadow AI reporting signale aux équipes sécurité l’usage par les employés d’applications IA web ou SaaS non autorisées. Le navigateur, point de contact privilégié entre l’utilisateur et la galaxie des IA, redevient ainsi un endpoint stratégique à instrumenter.

Trusted Cloud : IAM modernisée, donnée chiffrée, réseau armé

Au-delà des agents, Google met aussi à jour son socle dit Trusted Cloud, c’est-à-dire les contrôles natifs de la plateforme.

Côté IAM (Identity and Access Management — la couche qui régit qui a le droit de faire quoi sur quelle ressource), l’éditeur s’attaque à un mal historique du cloud : un catalogue de rôles si touffu que les administrateurs finissent par accorder, par facilité, beaucoup plus de droits qu’il n’en faut. Google rationalise donc son catalogue autour d’une trinité plus lisible – administrateur, éditeur et visionneur – déclinée par domaine. Il y ajoute un « role picker » assisté par Gemini, qui propose en langage naturel le rôle le mieux adapté à un besoin donné. Et l’IAM impose désormais une réauthentification obligatoire pour les actions les plus sensibles, afin de limiter la casse en cas de session compromise. Trois nouveautés qui, mises bout à bout, rendent enfin opérationnel le principe du moindre privilège, longtemps invoqué, trop rarement appliqué.

Côté sécurité des données, l’éditeur fait un pas important autour du Confidential Computing (l’informatique confidentielle). En partenariat avec NVIDIA, les machines virtuelles Confidential G4 embarquant les GPU NVIDIA RTX PRO 6000 Blackwell entrent en preview mondiale, taillées pour les charges IA sensibles. Avec Intel, ce sont les Confidential C4 VM (Intel TDX sur Xeon de sixième génération) qui débutent leur preview. Pour la gestion de clés, le Confidential External Key Manager (cEKM) entre, lui aussi, en preview : il permet d’héberger et de protéger des clés externes dans n’importe quelle région tout en conservant un contrôle vérifiable dans un environnement confidentiel. Indispensable pour répondre aux exigences réglementaires les plus strictes en matière de souveraineté.

Très emblématique également, Google annonce les KMS Quantum Safe Key Imports, en preview, qui permettent d’importer ses propres clés issues d’algorithmes résistants à la cryptographie post-quantique. La cryptographie post-quantique sort des laboratoires et commence donc à entrer dans les outils opérationnels. Une bonne nouvelle pour les RSSI déjà engagés dans une cartographie crypto-agility, à l’heure où les échéances se rapprochent : à partir de 2027, l’ANSSI n’acceptera plus en entrée de qualification des produits de sécurité dépourvus de PQC, et fixe à 2030 l’horizon au-delà duquel acheter des solutions non post-quantiques deviendra « déraisonnable ».

Enfin, le Secret Manager Agent Development Kit passe en disponibilité générale, taillé pour aider à prévenir les fuites de mots de passe et à atténuer les risques d’injection de prompts dans les workflows agentiques.

Côté réseau, le Cloud NGFW s’enrichit d’une advanced malware sandbox, attendue en preview plus tard cette année et adossée à Palo Alto Networks Advanced Wildfire, qui revendique 99 % de taux de blocage sur les malwares connus et inconnus, entraîné sur les données de plus de 70 000 clients de Palo Alto. Cloud Armor publie quant à lui de nouvelles règles managées propulsées par Thales Imperva (en preview), pour bloquer les attaques applicatives de niveau 7 et certaines CVE zero-day comme React2Shell.

Enfin, Security Command Center (SCC) étend ses capacités natives pour couvrir l’IA. Agents, modèles et serveurs MCP sont désormais sécurisés via une découverte continue et une analyse de risque exhaustive. SCC ajoutera bientôt, en preview, une visibilité runtime profonde pour révéler le shadow IA dans les workloads Google Cloud : détection automatique des agents non gérés, des serveurs MCP hébergés sur Cloud Run et GKE, et des points d’inférence sur GKE.

La sécurité, ultime juge de paix de l’ère agentique

Au-delà du flot d’annonces, ce que Google a livré à Las Vegas, c’est un changement de paradigme. Pendant vingt ans, la cybersécurité d’entreprise s’est structurée autour d’un postulat simple : on construit le SI, on lui adjoint une couche de défense, on alerte, un humain répond. Cette architecture, déjà éprouvée par la complexification du cloud, ne tient plus face à l’ère agentique.

Pour deux raisons que les annonces de Cloud Next viennent acter. D’abord, l’attaquant a changé de vitesse. Les vingt-deux secondes du dernier M-Trends signent la mort de la défense humaine au temps t. Soit on automatise la défense au même niveau que l’attaque, soit on accepte de perdre par défaut.

Ensuite, le défenseur a changé de surface d’attaque. L’irruption massive d’agents IA multiplie les identités non-humaines, brouille la frontière entre humain et automate sur le web, et ouvre des angles morts inédits — du vibe coding au shadow AI, en passant par les serveurs MCP non gouvernés et les extensions IDE qui siphonnent du code propriétaire. Aucun de ces risques n’existait dans la doctrine cyber de 2023.

C’est précisément ce double déplacement que Google entend adresser. Les agents Threat Hunting et Detection Engineering industrialisent le SOC, Wiz devient le bras armé multicloud du code-au-cloud, Agent Identity et Model Armor font de l’agent une identité gouvernée comme une autre, et Cloud Fraud Defense range l’agent parmi les visiteurs à arbitrer sur le web.

Au passage, en élargissant ainsi sa pile Cyber, Google s’aligne sur les arsenaux cyber de Microsoft (Defender XDR, Security Copilot) et d’AWS (Security Hub, GuardDuty, Bedrock Guardrails). Tous convergent vers le même horizon : un SOC agentique où la détection ne suffit plus et où la remédiation se pilote par IA.

Pour les RSSI, ces annonces sont autant de tendances qui réécrivent leur agenda 2026 : refactorer l’IAM en agentic identity management, instrumenter le navigateur, gouverner le shadow AI, déployer Model Armor à grande échelle, et anticiper la cryptographie post-quantique. Ils ont du pain sur la planche, mais n’ont que 22 secondes pour réagir…

À LIRE AUSSI :

À LIRE AUSSI :