Dev

BUILD 2025 (3/4) : Dev, Ops, Sécurité et conformité à l’ère agentique

Par Laurent Delattre, publié le 22 mai 2025

Le DevSecOps agentique n’est plus une vision, c’est une réalité à piloter dès aujourd’hui. GitHub, Entra, Purview, Defender : Microsoft assemble les briques d’un modèle où les agents IA sont gouvernés comme des collaborateurs humains.

L’essor fulgurant de l’IA agentique rebat les cartes de la cybersécurité et de la conformité. Chaque agent manipule des secrets, prend des décisions opérationnelles en toute autonomie et dialogue avec des données réglementées : un terrain idéal pour des attaques qui visent l’identité, la donnée et la chaîne d’approvisionnement logicielle.

Microsoft, qui entrevoit l’avènement des « Frontier Firms » où humains et agents collaborent au quotidien, a montré à Build 2025 comment sécuriser cette nouvelle ère agentique et comment ses équipes faisaient évoluer ses propres solutions pour répondre à ces nouveaux défis en posant une couche de sécurité et de gouvernance transversale, intégrée dès la conception et homogène du poste de travail au cloud.

Les DSI et RSSI vont en effet devoir très rapidement faire face au défi inédit de sécuriser un nombre croissant d’entités non humaines, exigeant une refonte des stratégies de sécurité traditionnelles. Au-delà de l’aspect quantitatif, la nature même des agents IA introduit des vulnérabilités dynamiques imprévisibles par leur capacité d’apprentissage et d’adaptation.

Parallèlement, la protection des données confidentielles se complexifie lorsque ces agents autonomes traitent des informations sensibles, nécessitant des cadres de gouvernance nouveaux pour maintenir un contrôle adéquat.

Avant d’aller plus loin et mieux comprendre la vision agentique de Microsoft, nous vous invitons, si ce n’est déjà fait à vous plonger dans la lecture de nos deux premières parties de notre compte-rendu de la conférence BUILD 2025 :

* L’agentification du travail avec la découverte de Copilot Tuning, Copilot Notebooks, Copilot Memory, Copilot Pages

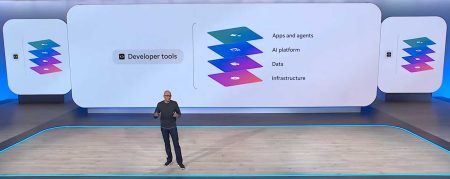

* Des usines à agents IA avec l’exploration de Azure AI Foundry, Foundry models, Foundry Agent Service, Foundry Observability, Model Router, Foundry Local, Agentic Web, NL Web, GitHub Copilot Coding Agent

Histoire de reprendre un peu là où nous avions arrêté l’histoire, voyons comment Microsoft imagine la chaîne DevSecOps à l’ère agentique avant de nous perdre dans les méandres de la sécurité des agents.

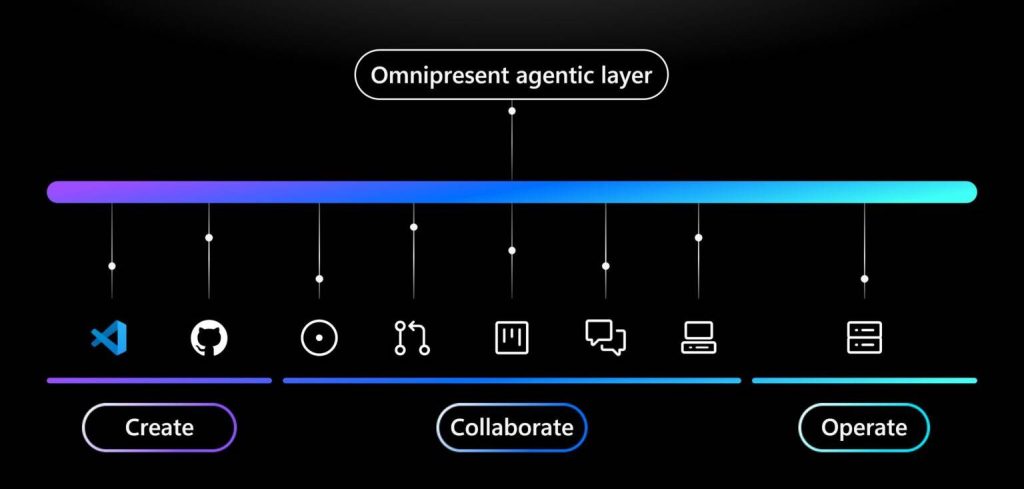

Réinventer le DevSecOps à l’ère agentique

À Build 2025, Microsoft a invité les entreprises à adapter leur vision DevSecOps pour mieux embrasser un « DevOps agentique » où des agents intelligents collaborent avec les humains et entre eux pour optimiser le cycle de vie logiciel. Cette approche libère les développeurs des tâches répétitives tout en permettant aux équipes opérationnelles de résoudre proactivement les problèmes en production, accélérant ainsi la mise sur le marché des applications et améliorant leur qualité.

Confier une partie du DevOps aux agents

Au cœur de cette vision, GitHub Copilot s’enrichit du mode « Agent » qui le transforme d’un simple « pair programmeur » en véritable « programmeur pair ». Capable d’analyser des bases de code complètes, d’effectuer des modifications inter-fichiers et de gérer des tâches complexes, comme les revues de code ou l’implémentation de spécifications, il réoriente le rôle du développeur humain vers l’architecture et la conception stratégique.

Quand la dette est gérée par des agents

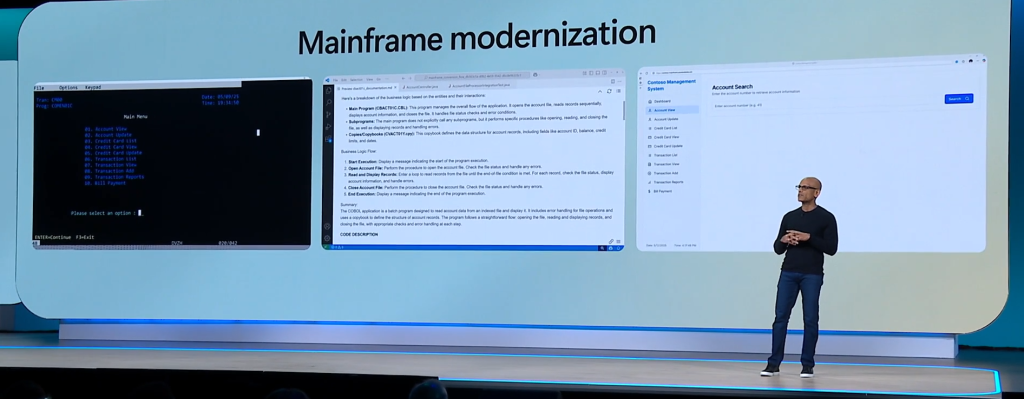

La gestion de l’héritage applicatif, un point sensible pour de nombreuses DSI, doit bien évidemment être adressée. GitHub Copilot peut désormais aider à moderniser les applications Java et .NET existantes en gérant les évaluations de code, les mises à jour de dépendances et les corrections.

La modernisation des systèmes mainframe a même été déjà envisagée. L’outil génère et exécute automatiquement des plans de mise à jour, tout en offrant une visibilité et un contrôle complets, ainsi qu’un résumé clair des modifications. L’utilisation de l’IA pour la modernisation pourrait ainsi débloquer des budgets et des ressources non négligeables, actuellement absorbés par la maintenance du legacy. Reste désormais à voir si l’idée peut réellement être mise en pratique. Rappelons toutefois qu’IBM adopte une approche très similaire et propose également un agent watsonx pour organiser et simplifier la migration des workloads mainframe.

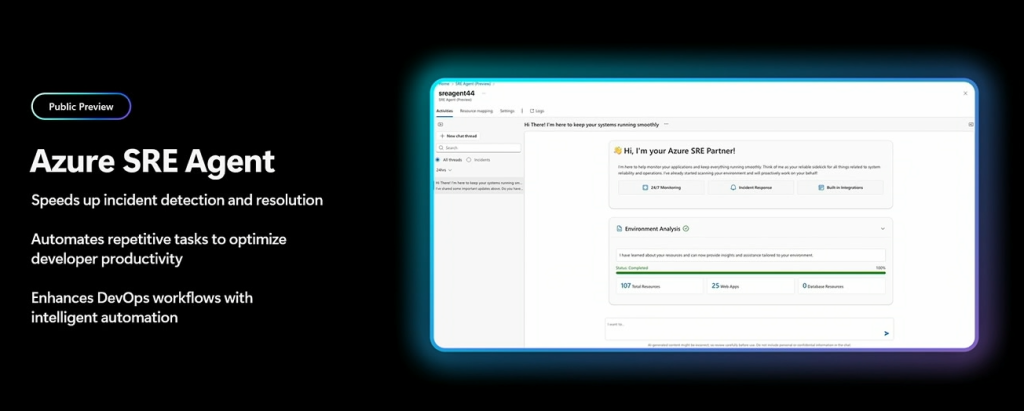

Des agents version Ops

Pour améliorer la résilience en production, Microsoft a annoncé à BUILD un nouvel agent SRE (Site Reliability Engineering) pour Azure. Cet agent surveille les systèmes de production (Azure Kubernetes Service, Azure App Service, environnements serverless et bases de données) 24h/24 et 7j/7. Il répond aux incidents en temps réel, dépanne de manière autonome les problèmes à mesure qu’ils surviennent, et peut guider l’analyse des causes profondes ou même résoudre les problèmes de façon autonome.

Les actions de remédiation ou les éléments de réparation identifiés sont consignés en tant que « issues » GitHub pour un suivi par l’équipe et peuvent même alors être automatiquement pris en charge par Gihub Copilot Coding Agent !

Cet agent SRE représente une première avancée vers des opérations informatiques auto-réparatrices (« self-healing »), susceptibles de transformer radicalement la gestion des incidents et d’améliorer significativement la disponibilité des services.

L’extension GitHub Copilot de VS Code passe en open source

C’est une demie surprise, mais elle est bienvenue. Microsoft a annoncé l’open-sourcing de GitHub Copilot dans VS Code. Les capacités dopées par l’IA des extensions GitHub Copilot feront désormais partie du dépôt open source de VS Code, l’outil de développement le plus populaire au monde (avec près de 50 millions d’utilisateurs actifs par mois).

Cette décision est un geste attendu en faveur d’une plus grande ouverture des outils IA et un engagement envers la transparence.

Construire la sécurité native de l’ère agentique

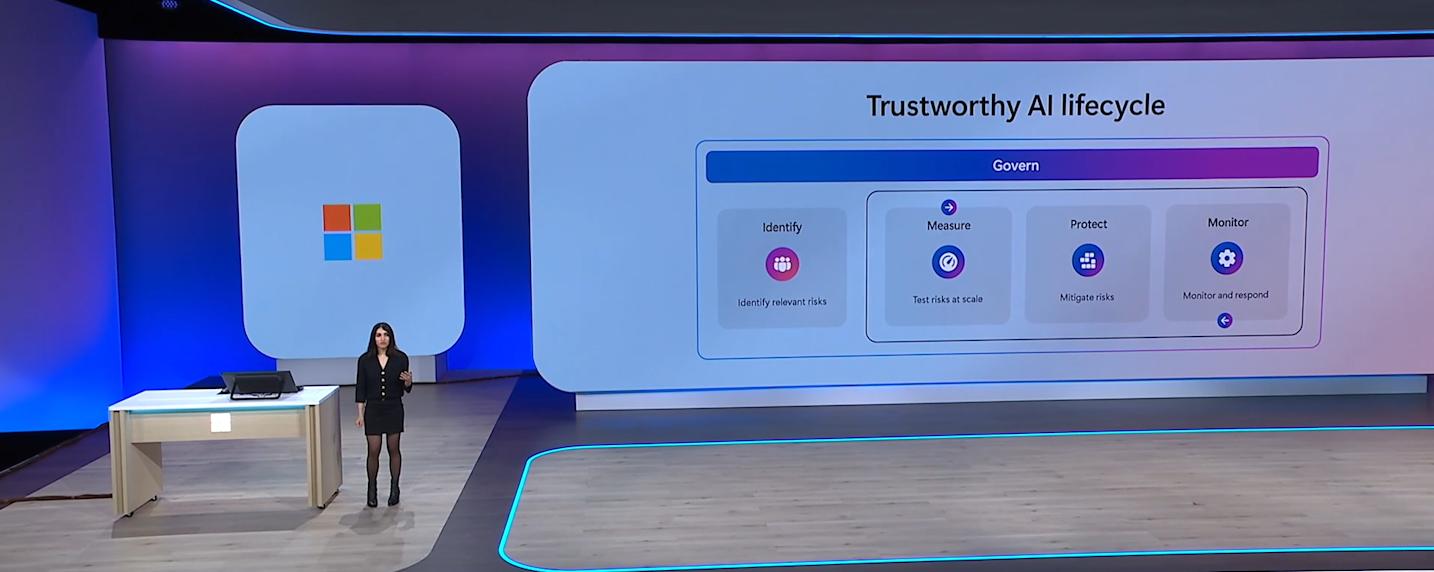

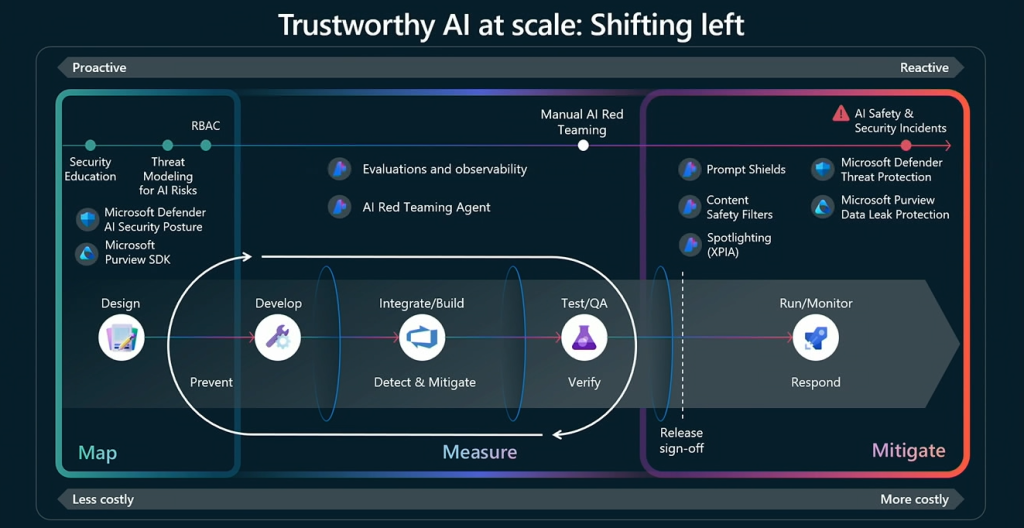

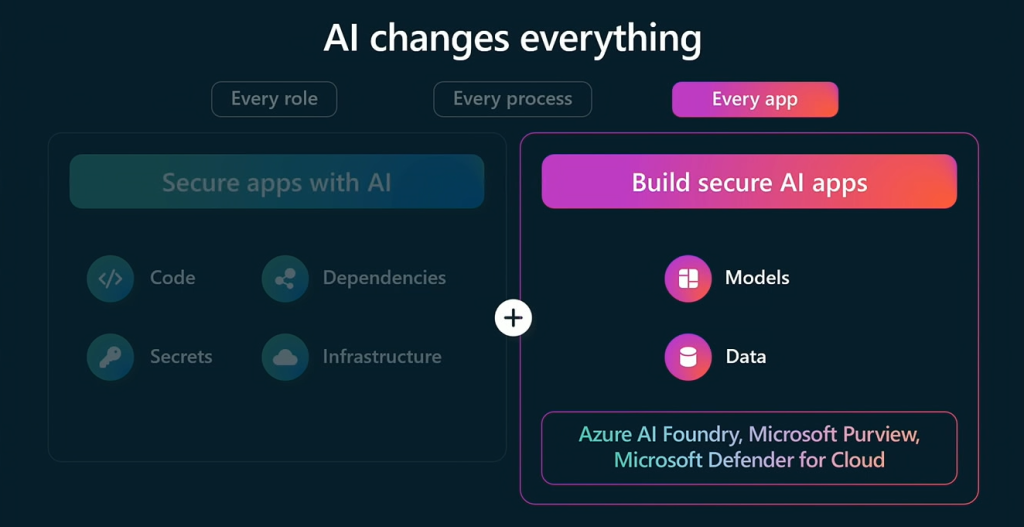

Parallèlement à la transformation du cycle de développement, Microsoft érige une couche de sécurité et de conformité transversale, spécifiquement dédiée à l’IA et à ses agents.

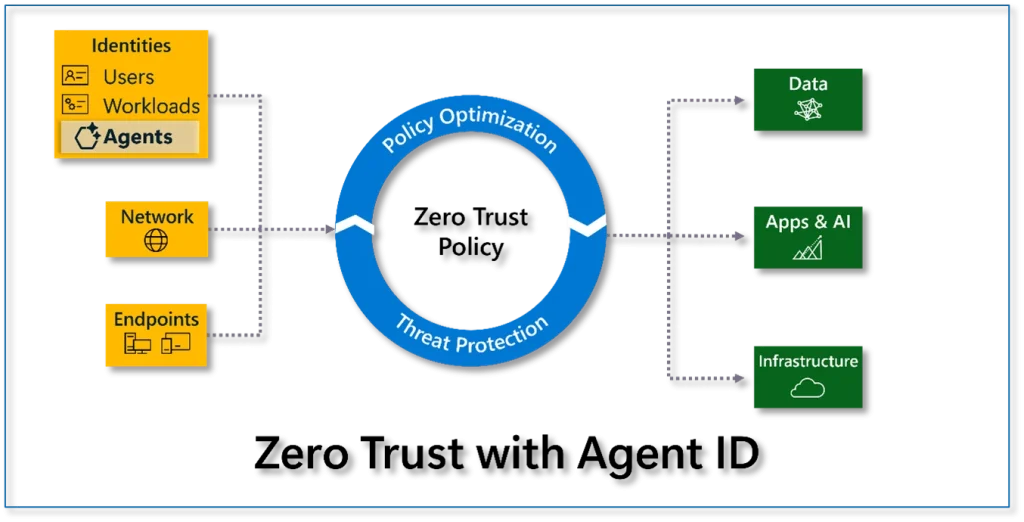

Des identités d’agents gérées dans Microsoft Entra

Comment gérer la sécurité d’une ruche d’agents IA ? En commençant par être en mesure de les identifier tout au long de leur cycle de vie ! C’est en substance la réflexion que s’est posée Microsoft. Avec une réponse évidente : puisqu’ils ont vocation à coopérer avec les humains et un peu comme les humains, pourquoi ne pas adopter les mêmes principes que les humains.

Dans l’univers Microsoft et Azure, les identités sont gérées par Microsoft Entra ID, solution bien plus connue sous son ancien nom « Azure AD » (pour Azure Active Directory). Il en sera donc de même pour les agents IA.

Microsoft Entra Agent ID révolutionne la gestion des identités en l’étendant aux agents. Ce système attribue automatiquement des identités uniques aux agents créés via Microsoft Copilot Studio et Azure AI Foundry, centralisant ainsi leur gestion aux côtés des utilisateurs humains dans l’annuaire Microsoft Entra. Cette approche garantit une authentification robuste et une gouvernance précise des capacités autonomes.

« L’authentification robuste, l’autorisation fine et la gouvernance sont essentielles ; Microsoft Entra Agent ID représente une avancée majeure », résume Frank Dickson d’IDC.

Chaque agent est ainsi administré comme un collaborateur humain : MFA, rôles, cycles de vie et audit unifiés.

Et Microsoft a déjà convaincu d’importants partenaires de le suivre dans sa logique. Des intégrations avec ServiceNow et Workday préparent ainsi l’on-boarding automatique de ces « digital employees ». Cette intégration avec des plateformes RH et ITSM marque une évolution significative : les agents IA deviennent une composante formelle de la main-d’œuvre, soumise à peu près aux mêmes processus de gouvernance que les collaborateurs humains.

Microsoft Purview, garant de la confidentialité et de la conformité

Et une autre brique essentielle du portfolio Microsoft Security est invitée à la fête des agents. Les risques de fuite ou de sur-partage de données croissent avec la prolifération d’agents. Et quand on parle fuite et protection de secrets, Microsoft Purview n’est jamais loin.

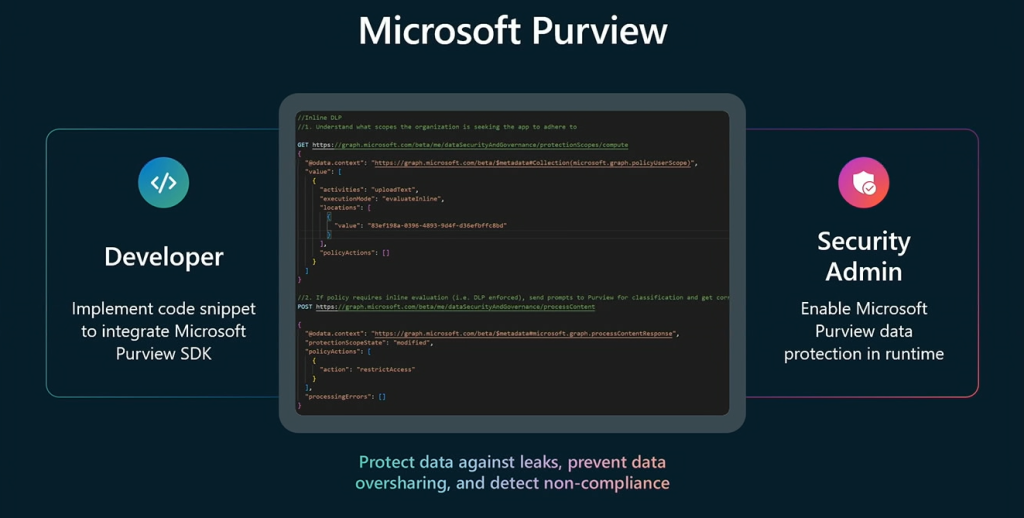

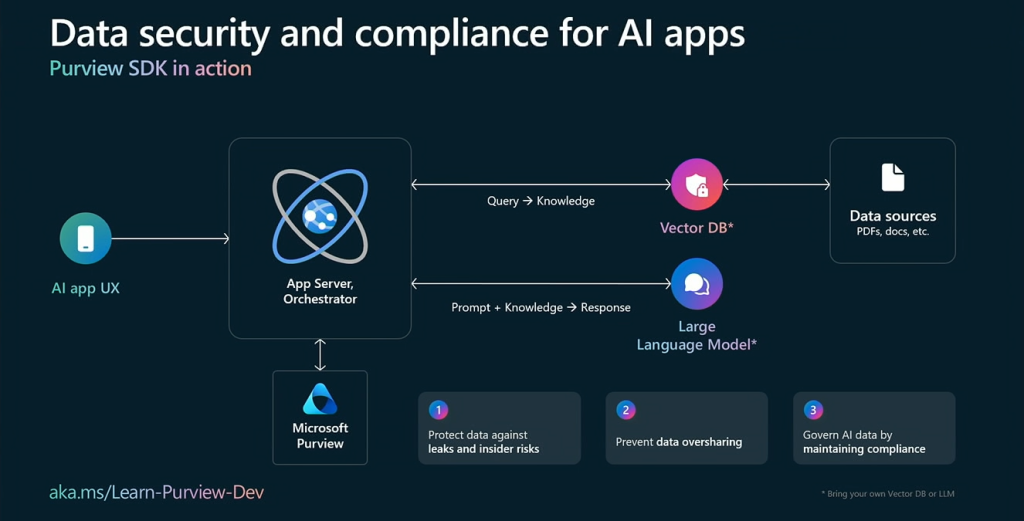

Pour sécuriser les données et garantir la conformité, Microsoft étend les contrôles de Microsoft Purview aux agents d’IA et aux solutions développées via Azure AI Foundry (la solution PaaS de création et gestion d’agents) et via Copilot Studio (la solution SaaS de création et gestion d’agents). Comme le résume Satya Nadella : « Purview s’intègre désormais à Foundry. Ainsi, lorsque vous écrivez un agent, automatiquement grâce à Purview, vous pouvez assurer une protection des données de bout en bout ».

Un nouveau SDK Microsoft Purview permet parallèlement d’intégrer ces protections dans les applications d’IA personnalisées via des API REST transmettant les données des interactions à Purview. Ce système classifie les requêtes en temps réel pour bloquer proactivement l’accès aux informations sensibles et générer des signaux d’alerte. Les équipes de sécurité peuvent ainsi surveiller les activités des agents et vérifier leur conformité aux politiques internes et réglementations externes.

La solution Purview Data Security Posture Management for AI identifie non seulement les risques liés aux données sensibles mais aussi les utilisations contraires à l’éthique de l’IA. Cette approche étend la gestion des risques internes et les capacités d’audit aux interactions avec les agents, y compris ceux destinés aux clients externes.

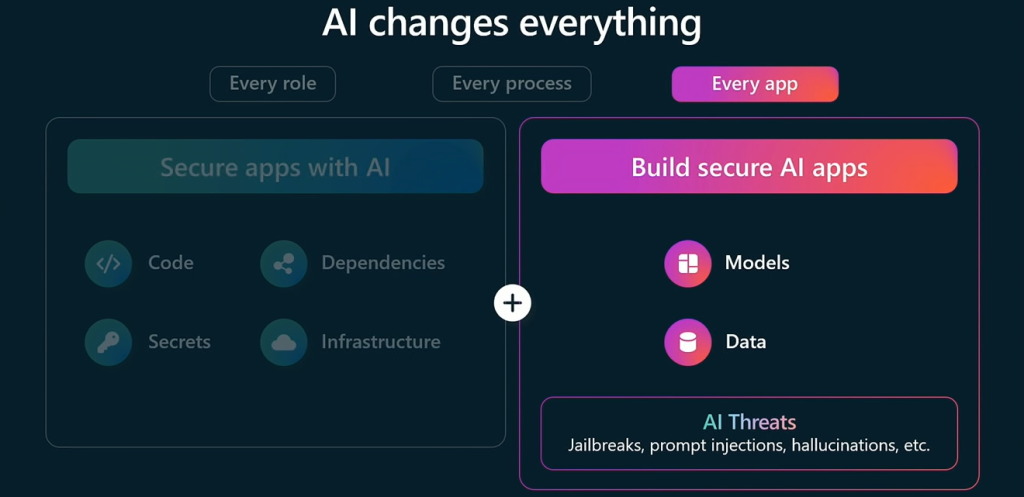

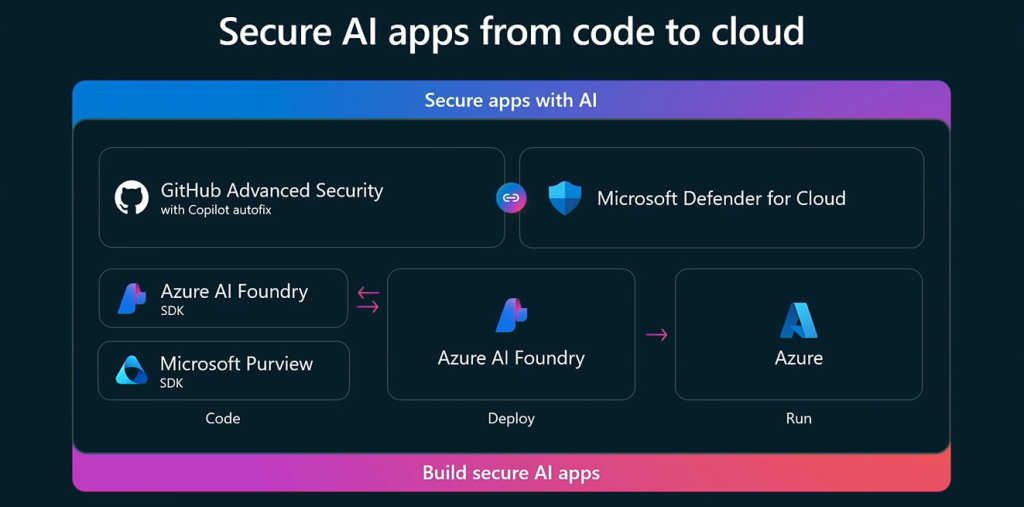

Microsoft Defender, le pont entre Dev et Sec

Enfin, histoire de compléter le triptyque bien connu, Microsoft Defender s’invite lui aussi dans Azure AI Foundry pour offrir une protection proactive des agents d’IA. Cette intégration rapproche les équipes de développement et de sécurité en permettant aux développeurs d’identifier et d’atténuer les risques dès la phase de construction. En effet, le système fournit en temps réel des recommandations sur la posture de sécurité, mettant en évidence les mauvaises configurations et vulnérabilités potentielles, tout en alertant sur les menaces actives spécifiques à l’IA comme les attaques de type « jailbreak », les fuites de données sensibles ou « l’abus de portefeuille ».

Microsoft développe ainsi des défenses ciblées contre ces nouveaux vecteurs d’attaque. Comme le souligne Satya Nadella : « Defender s’intègre désormais à Foundry. Cela signifie que vos agents sont également protégés, tout comme un point de terminaison le serait contre des menaces, telles que l’abus de portefeuille ou le vol d’identifiants. »

Avantage, les RSSI reçoivent les alertes de sécurité propres aux agents dans le même outil de contrôle du reste de l’infrastructure.

Au final, toutes les annonces de Microsoft Build 2025 dessinent une trajectoire claire vers une intégration profonde des agents IA dans l’entreprise. Et c’est vrai que l’on regarde du côté de Microsoft 365, de Dynamics 365, des plateformes de développement, de l’IT, de la cybersécurité comme de la conformité.

La prolifération d’agents capables de prendre des décisions et d’agir de manière autonome soulève des questions impératives sur la gouvernance que Microsoft prend déjà très au sérieux avec des solutions déjà opérationnelles comme Copilot Studio, Azure AI Foundry, Purview, Entra ID et Defender.

L’idée, finalement, est d’étendre le Zero Trust aux entités non humaines tout en posant les indispensables briques d’orchestration multi-agents et d’observabilité.

S’il faut retenir un enseignement de cette conférence Build, c’est que les technologies de l’ère agentique avancent encore plus vite que celles jusqu’ici rencontrées avec l’IA conversationnelle d’autant que l’IA contribue activement à cette accélération. Et l’on voit que Microsoft avance vite et probablement plus vite que les débats techniques, organisationnels, humains et politiques qui commencent à peine à émerger dans les entreprises.

Et les questions se bousculent. Comment adapter les politiques de conservation de données quand des agents génèrent et transforment des contenus en continu ? Quelle gouvernance mettre en place lorsqu’un agent modifie du code en production ? Comment faire évoluer les équipes alors que bien des rôles actuels sont menacés ou amenés à se transformer ? Comment gérer une entreprise où le nombre d’agents est amené à dépasser celui des collaborateurs dans bien des services d’ici deux à cinq ans ?

Build 2025 marque un point d’étape clair et ambitieux. Mais la feuille de route de l’ère agentique, elle, ne fait que commencer pour les DSI et RSSI.

PS La quatrième partie de notre compte rendu de la Build portera sur Windows et la réinvention du système à l’ère des agents IA.

À LIRE AUSSI :

À LIRE AUSSI :

À LIRE AUSSI :